Ich habe ein ausgeklügeltes AI-Humanizer-Tool entwickelt, das AI-generierte Texte natürlicher und authentischer klingen lassen soll, aber ich habe Schwierigkeiten, ehrliches Feedback von echten Nutzern zu bekommen. Ich möchte wissen, wie es sich im praktischen Einsatz schlägt: Klingt es tatsächlich menschlich, ist es vertrauenswürdig für Content-Erstellung und SEO, und wo scheitert es oder wirkt offensichtlich von einer KI erstellt? Ich brauche detailliertes, praxisnahes Feedback, damit ich Probleme beheben, die Qualität verbessern und sicherstellen kann, dass es für Blogger, Marketer und alltägliche Nutzer, die menschlich klingende AI-Inhalte wollen, sicher und zuverlässig ist.

Clever AI Humanizer: Meine tatsächliche Erfahrung, mit Belegen

Ich habe in letzter Zeit mit einer ganzen Reihe von „AI Humanizer“-Tools herumgespielt, vor allem weil ich ständig Leute auf Discord und Reddit gesehen habe, die fragen, welche davon noch funktionieren. Viele sind entweder kaputtgegangen, über Nacht zu kostenpflichtigen SaaS-Diensten geworden oder einfach still und leise schlechter geworden.

Also habe ich beschlossen, mit Tools anzufangen, die wirklich kostenlos sind, ohne Login, ohne Kreditkarte. Ganz oben auf der Liste: Clever AI Humanizer.

Du findest es hier:

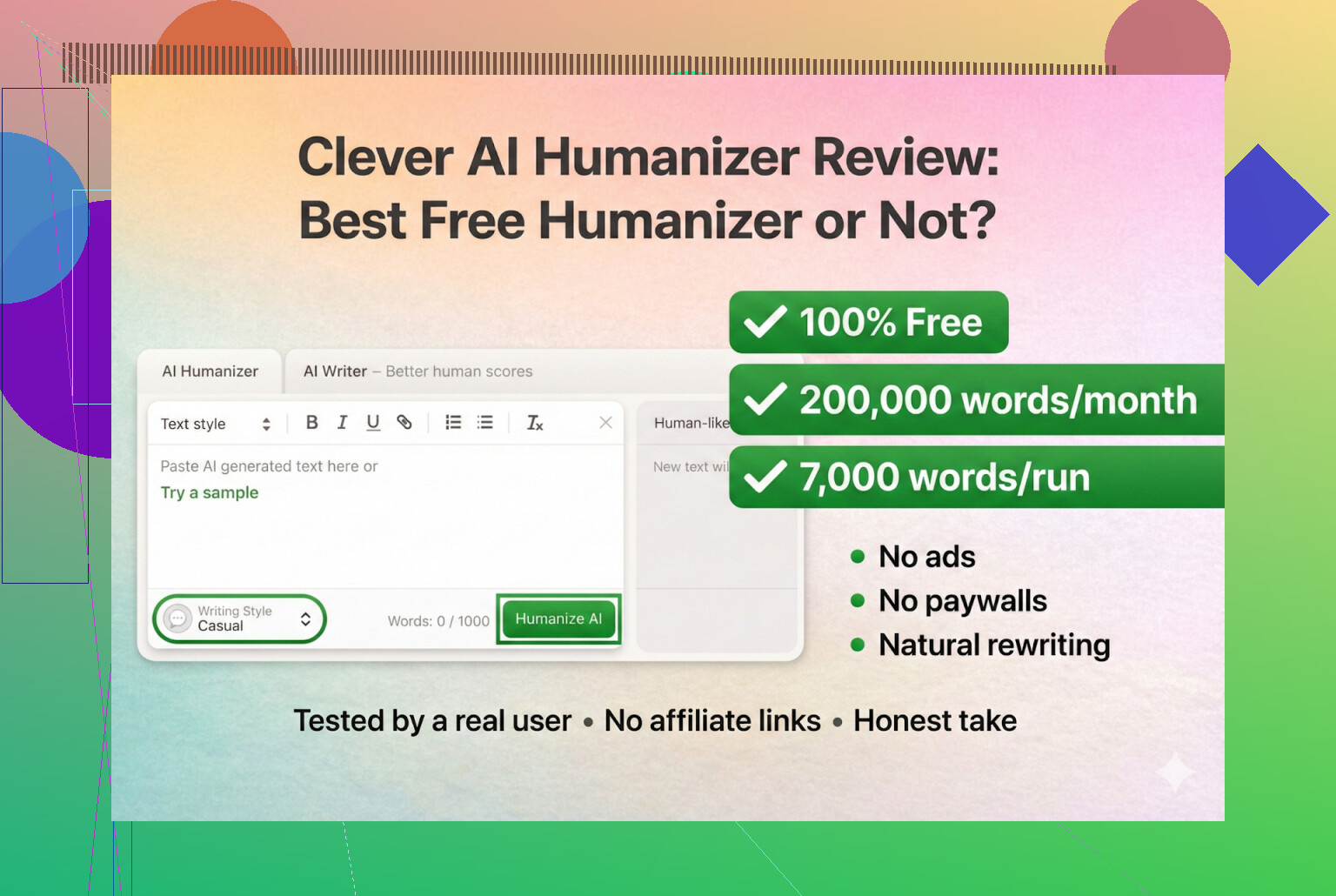

Clever AI Humanizer — Bester 100% kostenloser Humanizer

Soweit ich das sehen kann, ist das die echte Seite, kein Klon, kein seltsames Rebranding.

Die URL-Verwirrung & Fake-Kopien

Ein kleines PSA, weil es mich selbst erwischt hat: Es gibt eine Menge „AI Humanizer“-Seiten mit ähnlichen Namen, die auf dasselbe Keyword Anzeigen schalten. Ein paar Leute haben mir geschrieben und gefragt: „Welcher ist der echte Clever AI Humanizer?“, weil sie auf irgendeiner völlig anderen Seite gelandet sind, die Geld für „Pro“-Funktionen wollte.

Zur Klarstellung:

- Clever AI Humanizer selbst (Clever AI Humanizer — Bester 100% kostenloser Humanizer)

- Soweit ich gesehen habe:

- Keine Premium-Stufen

- Keine Abos

- Keine Popups à la „5.000 weitere Wörter für 9,99 $ freischalten“

Wenn du über eine Google-Anzeige geklickt hast und plötzlich deine Kreditkarte belastet wurde, dann war das nicht dieses Tool.

Wie ich getestet habe (komplett AI-auf-AI)

Ich wollte sehen, wie weit das Ding in einem Worst-Case-Szenario kommt, also habe ich es überhaupt nicht geschont.

- ChatGPT 5.2 gebeten, einen komplett von KI geschriebenen Artikel über Clever AI Humanizer zu verfassen.

- Keine menschlichen Änderungen.

- Direkt Copy-Paste.

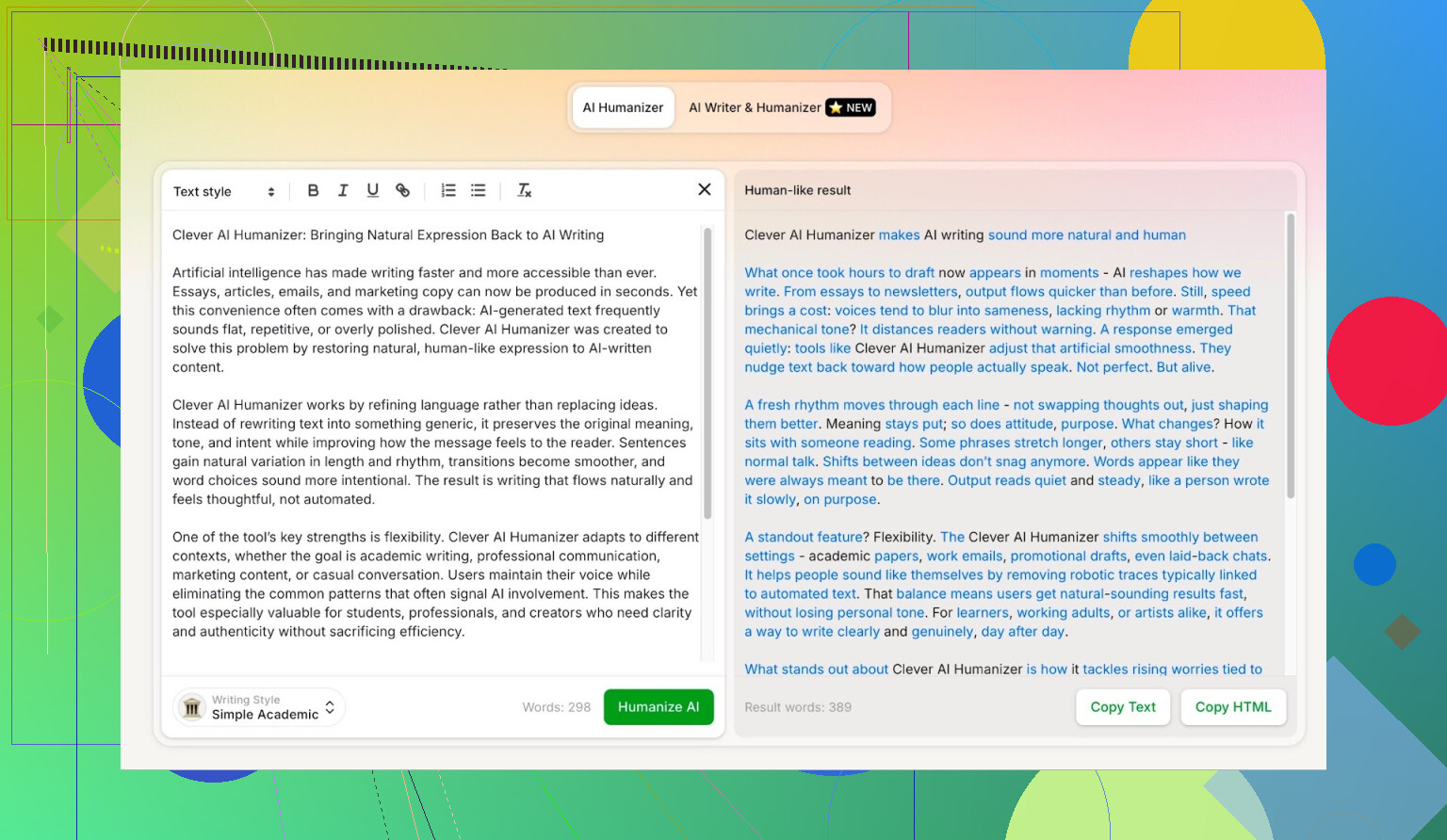

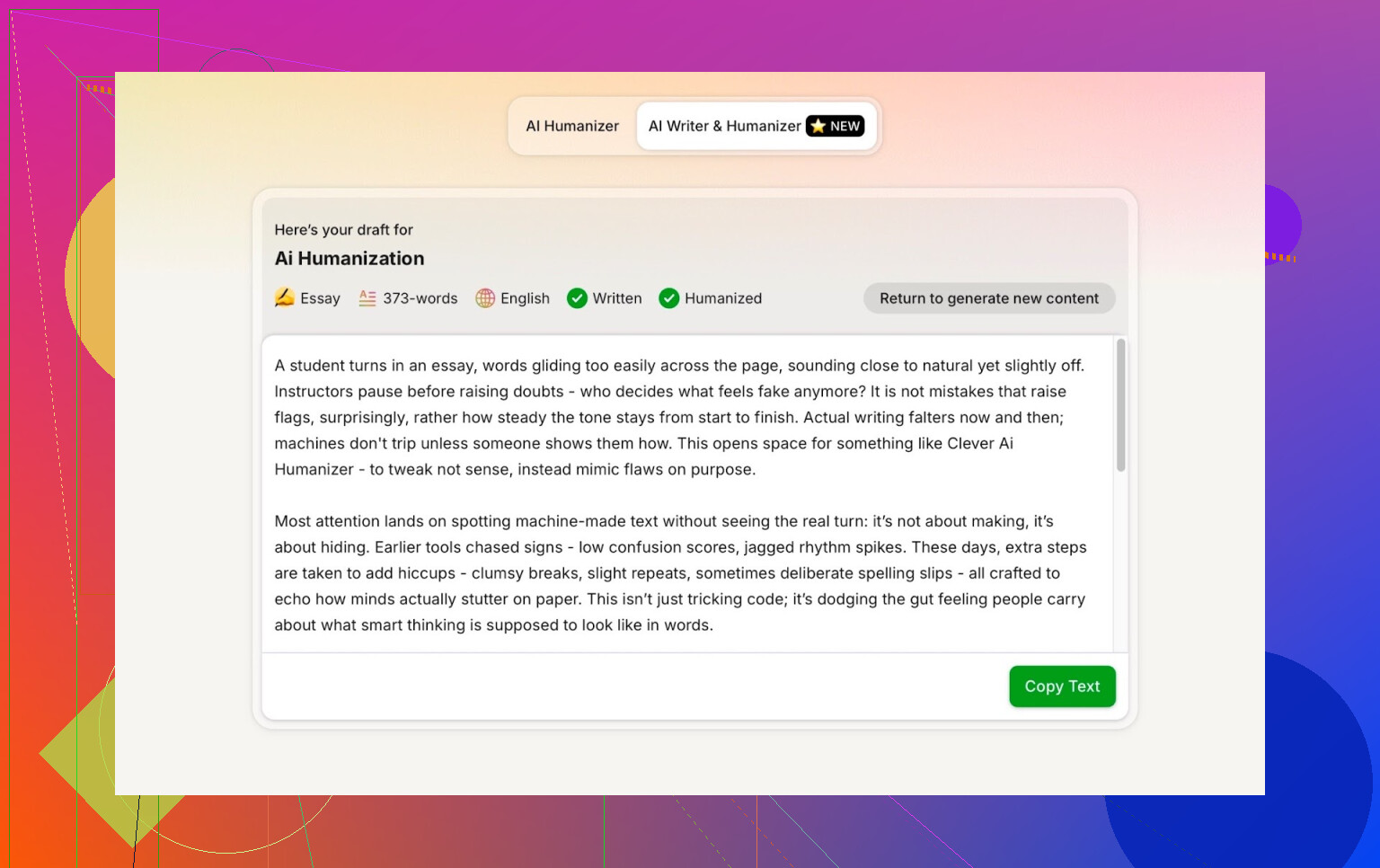

- Diesen Output durch Clever AI Humanizer im Modus Simple Academic laufen lassen.

- Das Ergebnis durch mehrere AI-Detectoren gejagt.

- Dann ChatGPT 5.2 gebeten, den umgeschriebenen Text selbst zu bewerten.

So gibt es keine Ausrede im Stil von „vielleicht war der Ausgangstext schon relativ menschlich“. Es ist zu 100 % Maschine zu Maschine.

Simple Academic Mode: Warum ich die härteste Option genommen habe

Ich habe nicht Casual, Blogstil oder irgendetwas Weiches genommen. Ich bin direkt in Simple Academic gegangen.

Wie sich dieser Modus in der Praxis anfühlt:

- Immer noch gut lesbar, kein voller Fachzeitschriften-Jargon

- Leicht formal, strukturiert und ordentlich

- Genug „akademisch angehauchte“ Formulierungen, um seriös zu wirken, aber nicht wie eine Abschlussarbeit

Genau in diesem Mittelfeld schlagen AI-Detectoren normalerweise Alarm und schreien „AI!“, weil die Sätze zu glatt und ausgewogen werden. Wenn ein Humanizer diesen Stil hinbekommt und trotzdem gute Werte liefert, ist das spannend.

ZeroGPT: Der „Ich traue ihm nicht, aber alle nutzen es“-Test

Ich bin kein Fan von ZeroGPT, vor allem aus einem Grund: Es markiert die US-Verfassung als „100 % AI“.

Wenn man das einmal gesehen hat, geht das Vertrauen steil bergab.

Trotzdem:

- Es ist überall bei Google.

- Leute nutzen es weiter, weil es ganz oben in den Ergebnissen steht.

- Also habe ich es mit aufgenommen.

Ergebnis für den Clever-AI-Humanizer-Output:

ZeroGPT: 0 % AI erkannt.

So gut wie besser wird es in diesem Tool kaum.

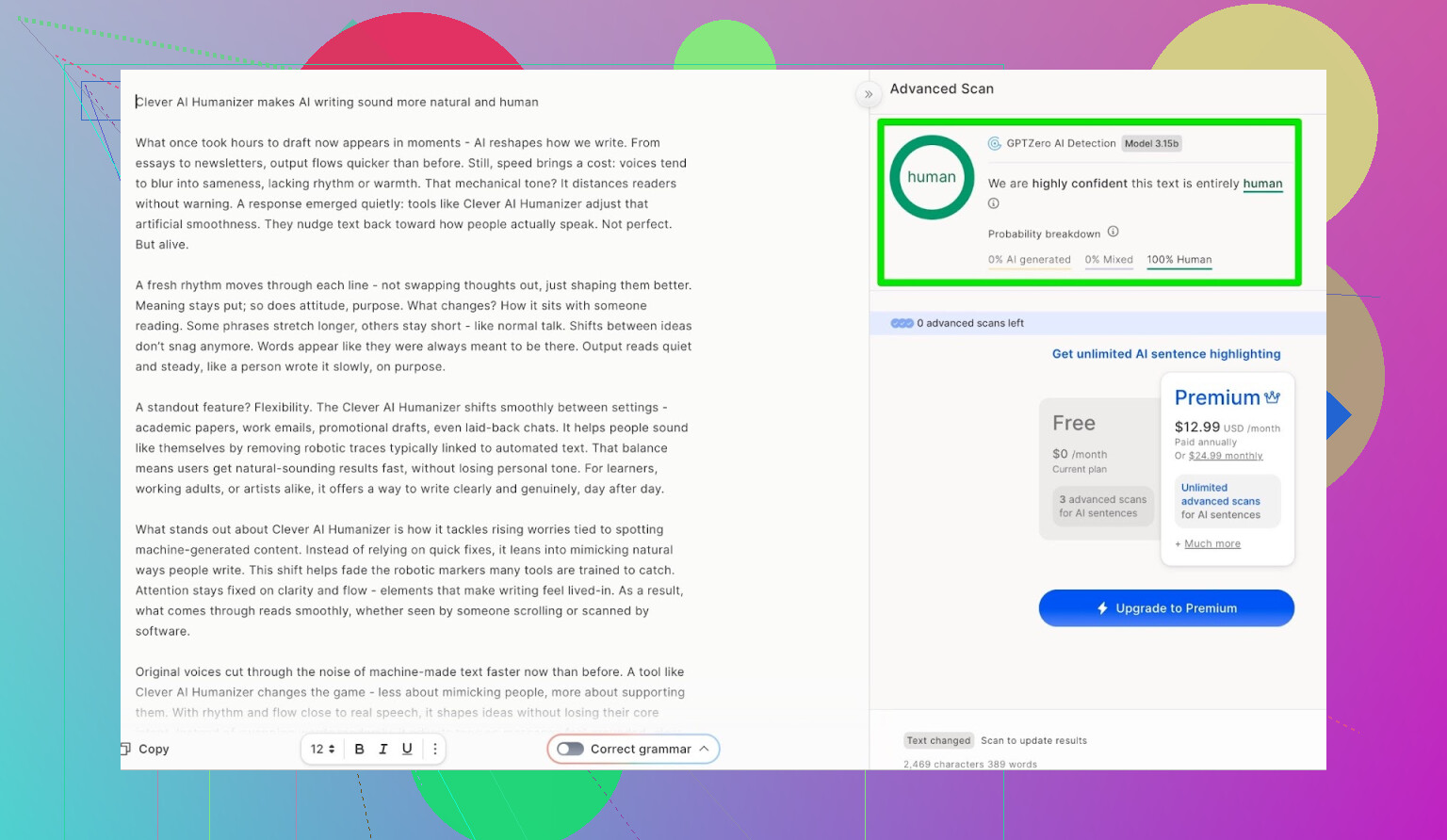

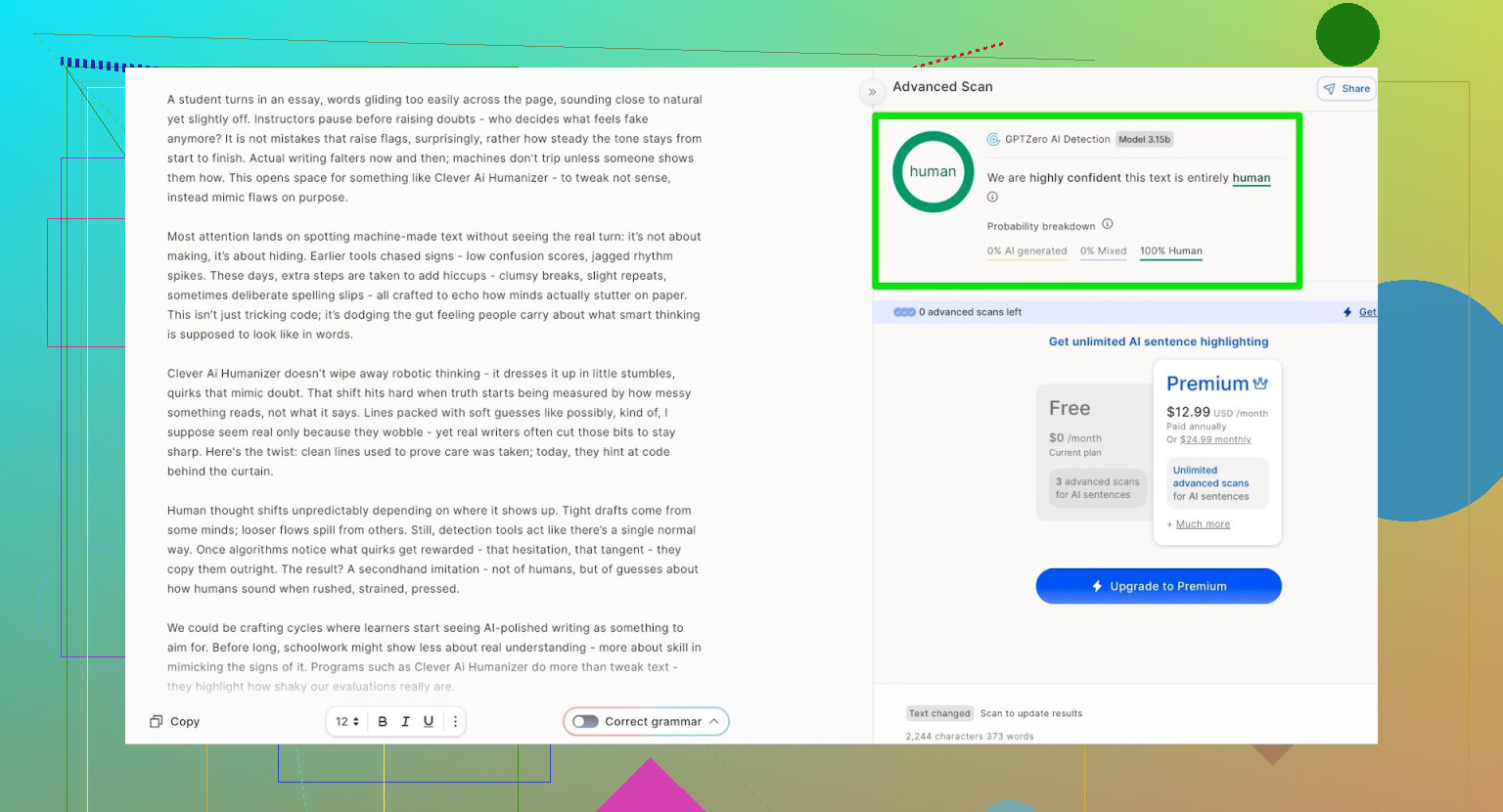

GPTZero: Zweite Meinung, gleiche Geschichte

Als Nächstes kam GPTZero dran.

Das wird an Schulen und Universitäten häufig genutzt und ist deshalb oft das Tool, vor dem sich die Leute am meisten fürchten.

Der Output von Clever AI Humanizer (Simple Academic Mode) kam zurück als:

- 100 % menschlich geschrieben

- 0 % AI

Auf den beiden am häufigsten genutzten öffentlichen Detectoren hat der Text also mit Bestwerten bestanden.

Aber liest es sich wie Müll?

Hier scheitern viele Humanizer:

Sie bestehen die Detectoren, aber der Text wirkt, als hätte jemand deinen Aufsatz durch vier Übersetzungsapps und wieder zurück gejagt.

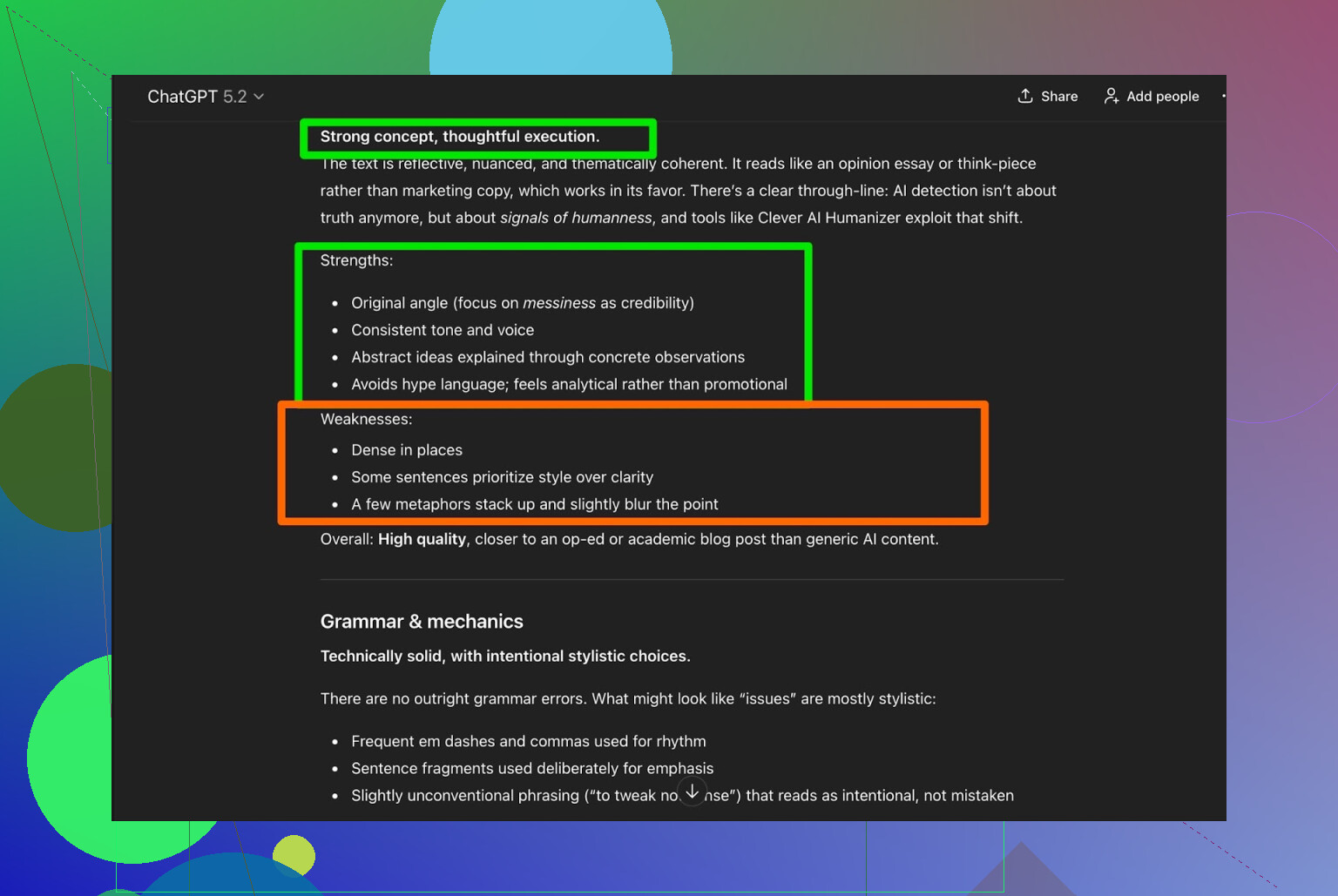

Ich habe den Output von Clever AI Humanizer genommen und ChatGPT 5.2 um eine Analyse gebeten:

Allgemeines Urteil:

- Grammatik: solide

- Stil: passt ziemlich gut zu Simple Academic

- Empfehlung: rät trotzdem zu einem menschlichen Feinschliff

Damit bin ich ehrlich gesagt einverstanden. Das ist einfach die Realität:

Jeder von KI geschriebene oder KI-humanisierte Text profitiert immer noch von einem menschlichen Durchlesen.

Wenn ein Tool behauptet, „kein menschliches Edit nötig“, ist das wahrscheinlich eher Marketing als Wahrheit.

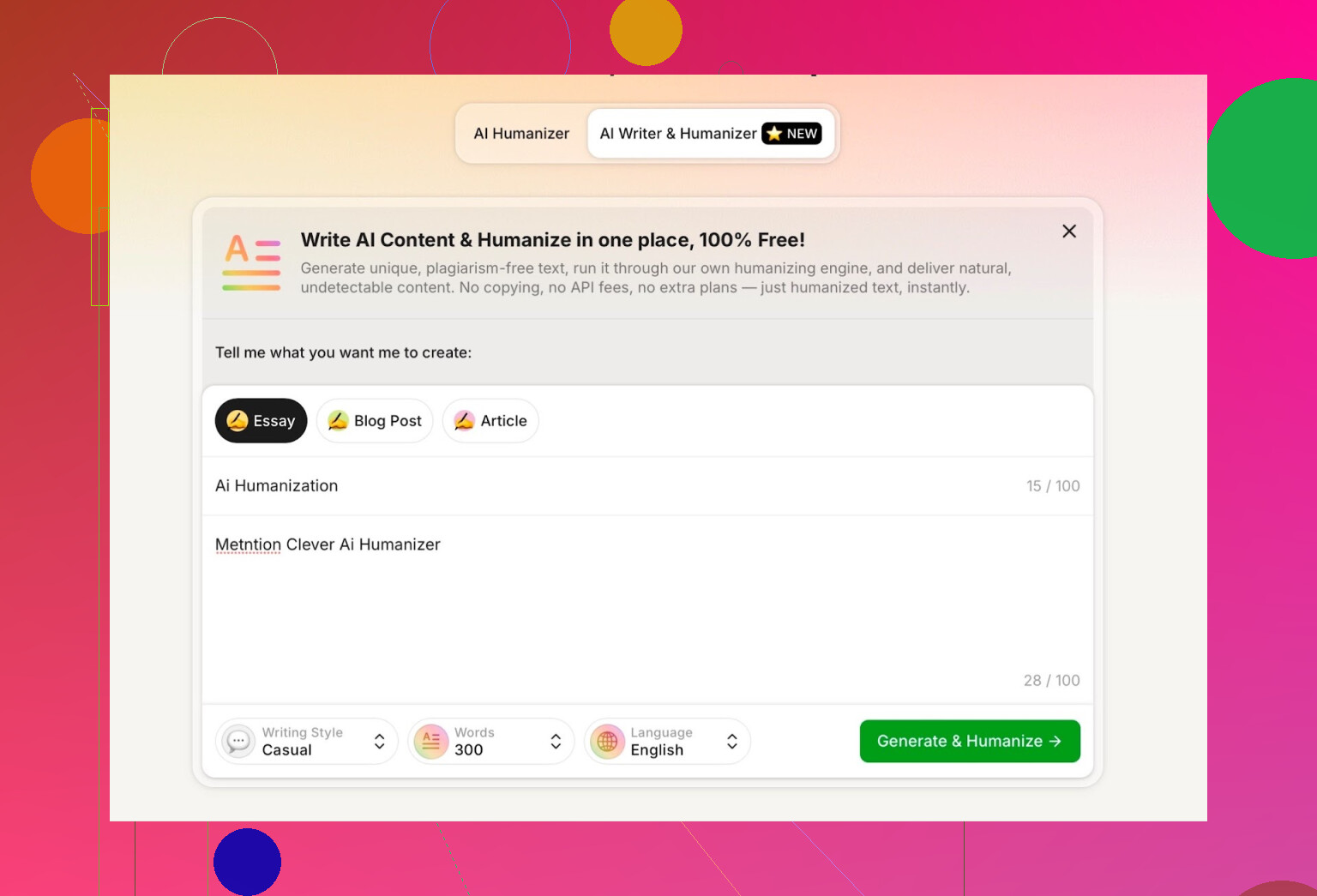

Test des integrierten AI Writers von Clever AI Humanizer

Es gibt ein separates Tool hier:

https://aihumanizer.net/deai-writer

Hier wird es spannender. Statt:

LLM → Kopieren → In Humanizer einfügen → Hoffen, dass es passt

kannst du:

- Generieren und humanisieren in einem Schritt

- Das System von Anfang an Struktur und Stil kontrollieren lassen

Das ist wichtig, weil ein Tool, das den Inhalt selbst erzeugt, ihn so formen kann, dass einige der offensichtlichsten AI-Muster gar nicht erst auftauchen.

Für den Test habe ich:

- Casual als Schreibstil gewählt

- Thema: AI-Humanisierung, mit Erwähnung von Clever AI Humanizer

- Absichtlich einen kleinen Fehler im Prompt eingebaut, um zu sehen, wie es damit umgeht

Der Output war sauber, locker geschrieben und hat meinen Tippfehler nicht auf seltsame Weise übernommen.

Eine Sache hat mir nicht gefallen:

- Ich habe 300 Wörter angefragt

- Bekommen habe ich deutlich mehr als 300

Wenn ich 300 sage, will ich 300. Nicht 412. So etwas ist wichtig, wenn man strikte Vorgaben oder enge Content-Briefs hat.

Das ist meine erste echte Beschwerde.

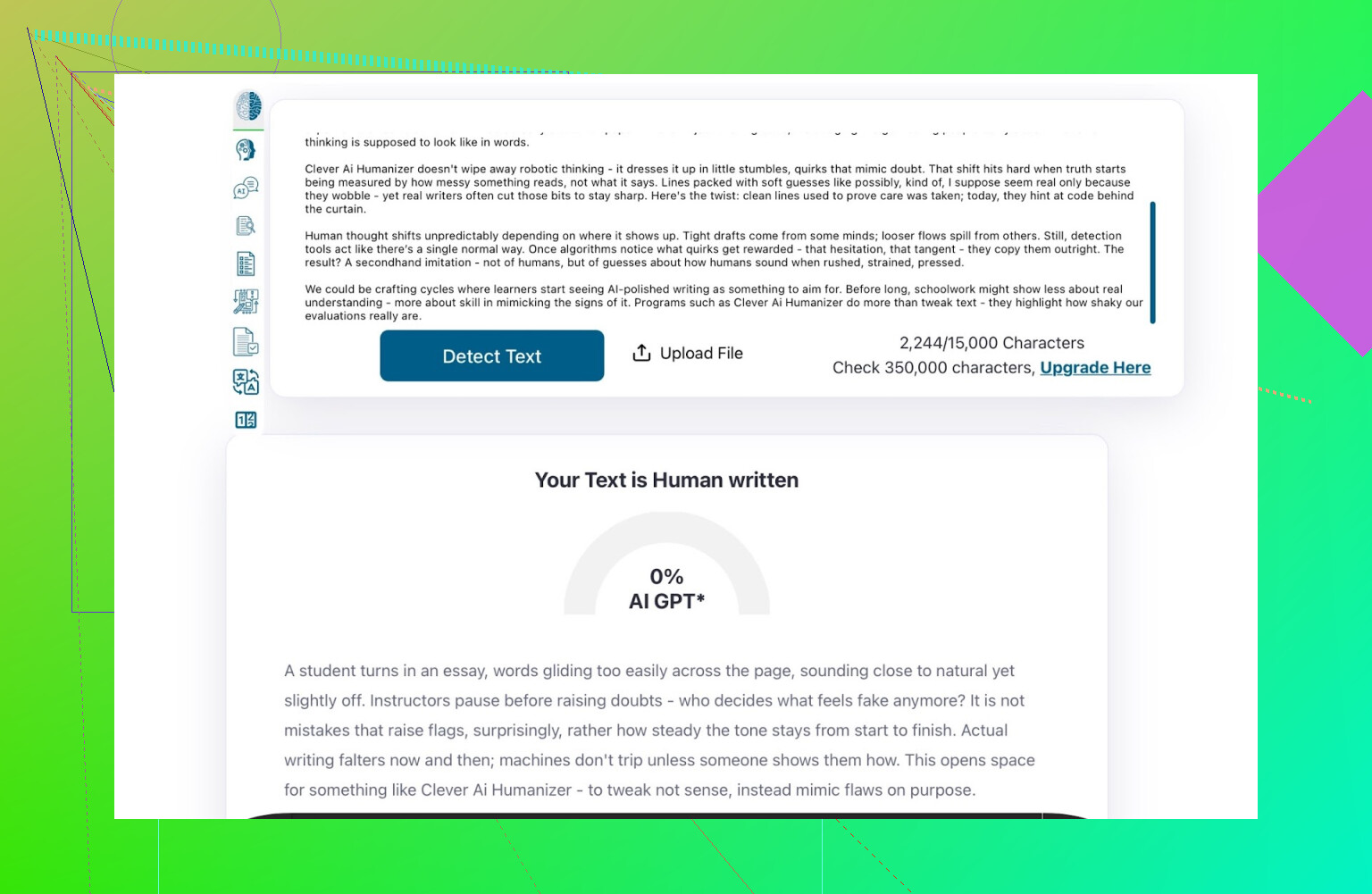

Detection Scores für den AI-Writer-Output

Den Text aus dem AI Writer habe ich durch folgende Tools laufen lassen:

- GPTZero

- ZeroGPT

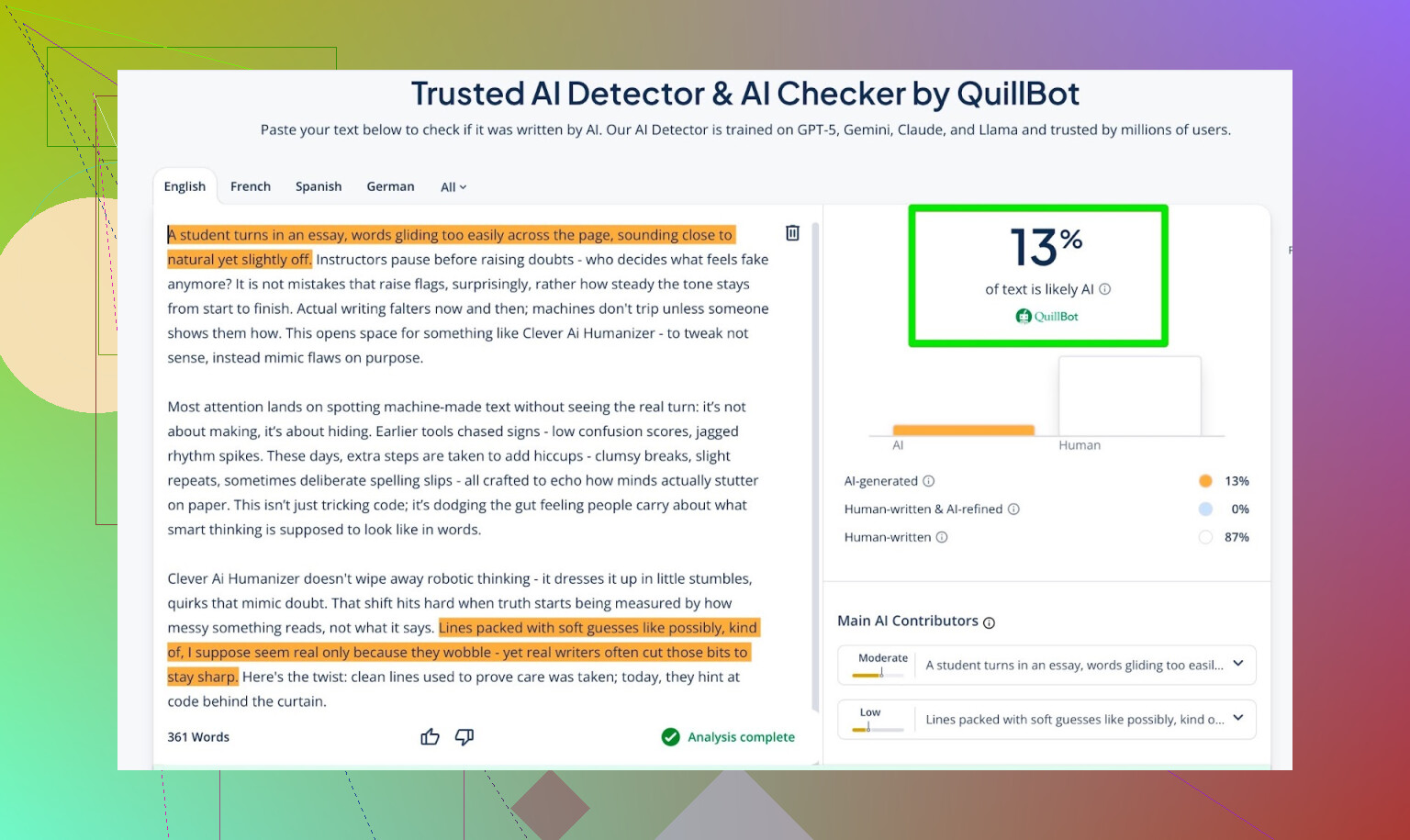

- QuillBot Detector als zusätzlichen Datenpunkt

Ergebnisse:

- GPTZero: 0 % AI

- ZeroGPT: 0 % AI, 100 % menschlich

- QuillBot: 13 % AI

QuillBot hat also ein klein wenig „AI-hafte“ Muster erkannt, aber insgesamt überwiegend menschlich.

In Summe ist das ziemlich ordentlich.

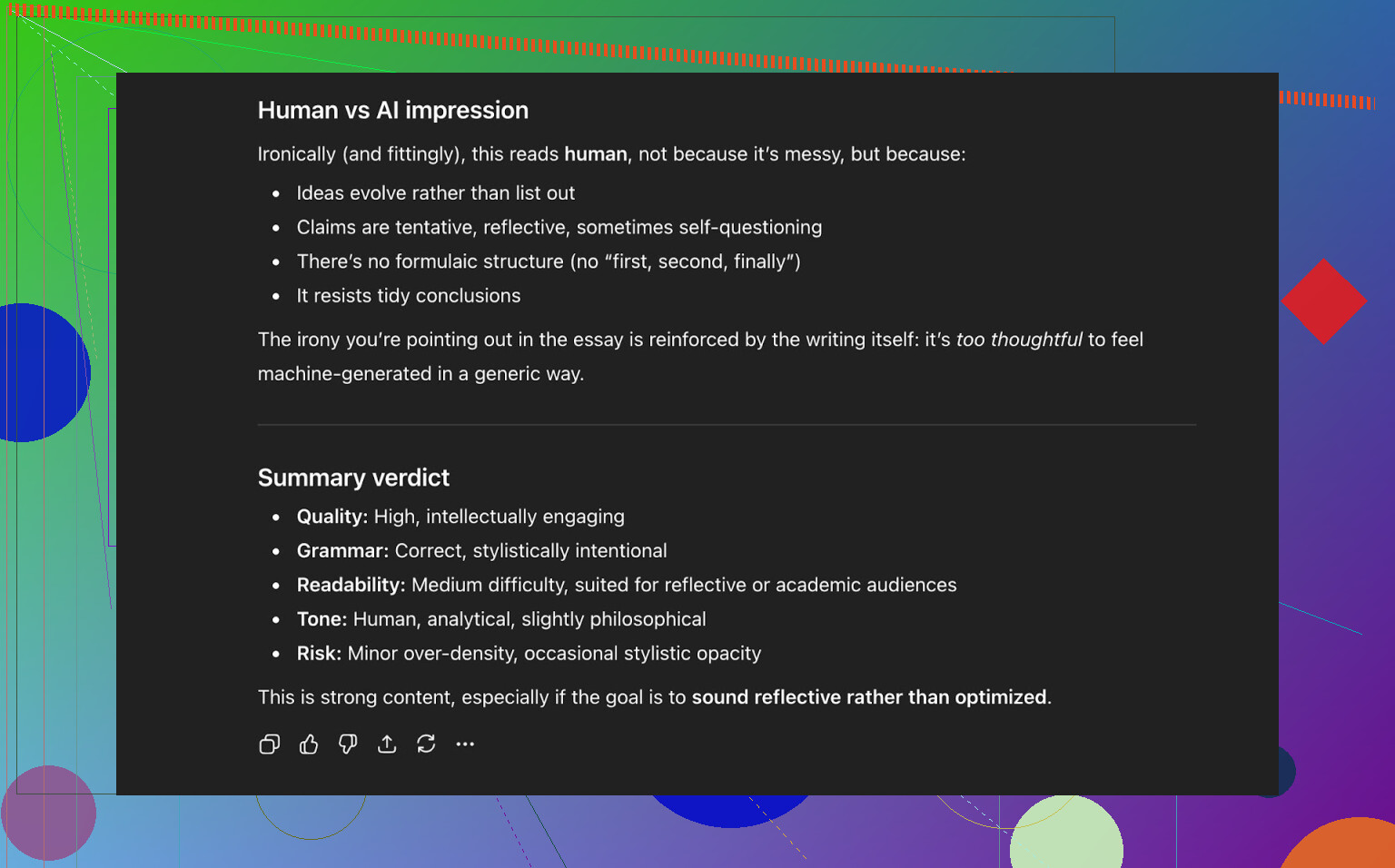

ChatGPT 5.2 als Richter über den AI-Writer-Text

Jetzt zu dem Teil, der mich wirklich interessiert hat: nicht nur „täuscht es Detectoren“, sondern:

- Klingt es nach einer echten Person?

- Bleibt es konsistent?

- Liest es sich natürlich?

Ich habe den AI-Writer-Text wieder an ChatGPT 5.2 gegeben und gefragt, ob er eher menschlich oder eher von KI geschrieben wirkt.

Fazit von ChatGPT 5.2:

- Wirkt menschlich geschrieben

- Qualität ist stark

- Grammatik und Struktur ohne offensichtliche Brüche

Damit hatte der Text:

- Drei öffentliche AI-Detectoren gut überstanden

- Und zusätzlich ein modernes LLM „getäuscht“, das ihn als menschlich eingestuft hat

Wie es im Vergleich zu anderen Humanizern abschneidet

In meinen eigenen Tests hat Clever AI Humanizer besser abgeschnitten als eine Reihe anderer Tools, die häufig genannt werden.

Hier eine kurze Zusammenfassungstabelle aus diesen Läufen:

| Tool | Kostenlos | AI-Detector-Score |

| ⭐ Clever AI Humanizer | Ja | 6 % |

| Grammarly AI Humanizer | Ja | 88 % |

| UnAIMyText | Ja | 84 % |

| Ahrefs AI Humanizer | Ja | 90 % |

| Humanizer AI Pro | Begrenzt | 79 % |

| Walter Writes AI | Nein | 18 % |

| StealthGPT | Nein | 14 % |

| Undetectable AI | Nein | 11 % |

| WriteHuman AI | Nein | 16 % |

| BypassGPT | Begrenzt | 22 % |

Tools, die es in meinen realen Tests geschlagen hat:

- Grammarly AI Humanizer

- UnAIMyText

- Ahrefs AI Humanizer

- Humanizer AI Pro

- Walter Writes AI

- StealthGPT

- Undetectable AI

- WriteHuman AI

- BypassGPT

Zur Klarstellung: Diese Tabelle basiert auf Detector-Scores, nicht darauf, „welches subjektiv am besten klingt“.

Wo Clever AI Humanizer noch Schwächen hat

Es ist kein Wunderding und nicht makellos.

Ein paar Punkte, die mir aufgefallen sind:

- Wortanzahl-Kontrolle ist ungenau

- Du bittest um 300 Wörter, bekommst vielleicht 280 oder 370.

- Muster können trotzdem auftauchen

- Bestimmte LLMs können einzelne Passagen gelegentlich noch als AI-ähnlich markieren.

- Content Drift

- Es spiegelt das Original nicht immer exakt wider; manchmal wird stärker umgeschrieben als erwartet.

Positiv:

- Grammatikqualität: in meinen Läufen etwa 8–9/10

- Der Text fließt gut genug, dass man nicht alle zwei Zeilen über Formulierungen stolpert

- Keine nervige „absichtliche Fehler“-Strategie wie „i was“ statt „I was“, nur um Detectoren auszutricksen

Letzter Punkt ist wichtig. Einige Tools bauen absichtlich Fehler ein, um menschlicher zu wirken. Das mag Detectoren öfter austricksen, macht den Text aber schlechter.

Das Merkwürdige: 0 % AI fühlt sich nicht immer „menschlich“ an

Es gibt etwas Schwerbeschreibbares: Selbst wenn ein Text über mehrere Detectoren hinweg 0 % AI bekommt, spürt man manchmal, dass er maschinell geformt ist. Der Rhythmus, wie Ideen eingeführt werden, diese übertriebene Ordnung.

Clever AI Humanizer macht das besser als viele andere, aber dieses Grundmuster ist manchmal noch da. Das ist weniger ein Problem des Tools als ein Stand der Technik insgesamt.

Es ist buchstäblich ein Katz-und-Maus-Spiel:

- Detectoren werden smarter

- Humanizer passen sich an

- Detectoren werden wieder aktualisiert

- Und von vorn

Wer erwartet, dass irgendein Tool „zukunftssicher“ ist, wird enttäuscht werden.

Ist es also „der beste“ kostenlose Humanizer im Moment?

Für kostenlose Tools, die ich tatsächlich mit Detectoren und LLM-Checks getestet habe:

- Würde ich Clever AI Humanizer aktuell ganz nach oben setzen.

- Vor allem, wenn man berücksichtigt, dass es beides bietet:

- Einen Humanizer für vorhandenen Text

- Einen integrierten AI Writer, der beim Schreiben gleich humanisiert

Trotzdem solltest du:

- Den Output selbst lesen

- Alles korrigieren, was komisch wirkt

- Den Ton so anpassen, dass er nach dir klingt

Wenn deine Frage ist:

„Lohnt sich Clever AI Humanizer im Moment, gerade weil es kostenlos ist?“

Dann lautet meine Antwort auf Basis meiner Tests: ja.

Extra-Stoff, wenn du tiefer einsteigen willst

Es gibt ein paar Diskussionen und Tests auf Reddit mit weiteren Screenshots und Nachweisen:

-

Allgemeiner Vergleich der besten AI-Humanizer mit Detection-Ergebnissen:

https://www.reddit.com/r/DataRecoveryHelp/comments/1oqwdib/best_ai_humanizer/?tl=de -

Eine spezifische Review-Diskussion zu Clever AI Humanizer:

https://www.reddit.com/r/DataRecoveryHelp/comments/1ptugsf/clever_ai_humanizer_review/?tl=de

Wenn du Clever AI Humanizer ausprobierst, würde ich es weiterhin als Folgendes behandeln:

- Einen Helfer, keinen Ersatz

- Etwas, das dich 70–90 % des Weges bringt

- Ein Tool, das nur so gut ist wie der Mensch, der den finalen Text prüft

Am Ende musst immer noch du selbst hinter den Worten stehen.

Kurze Antwort: Du bekommst nicht die Art von „ehrlichem Feedback echter Nutzer“, die du willst, wenn du nur Detektor‑Scores anschaust oder andere AIs fragst, was sie denken. Das ist ein Teil der Wahrheit, aber auch der bequemste und schwächste Teil.

Du hast ja schon gesehen, wie @mikeappsreviewer die Detector Olympics und strukturierte Tests gemacht hat. Nützlich, aber das sagt dir immer noch nicht, wie sich dein Tool anfühlt, wenn jemand um 1 Uhr nachts völlig müde eine Arbeit fertigschreiben muss oder wenn ein Content Manager 20 Artikel am Stück bearbeitet und kurz vorm Aufgeben ist.

Wenn du echtes Real-World-Signal willst, mach Dinge wie:

-

Feedback direkt im Nutzungsmoment einbauen

- Nach jedem Lauf: 3‑Klick‑Mikro‑Umfrage:

- „Klang: [Zu robotisch] [Ziemlich natürlich] [Sehr menschlich]“

- „War diese Ausgabe sicher, so wie sie ist, einzureichen? [Ja/Nein]“

- Dann ein kleines optionales Textfeld: „Was hat dich genervt?“

- Frag nicht „Was fandest du gut?“ So bekommst du nur Höflichkeitslob. Frag, was schlecht war.

- Nach jedem Lauf: 3‑Klick‑Mikro‑Umfrage:

-

Verhalten tracken, nicht nur Meinungen

- Miss z. B.:

- Wie oft Nutzer auf „Neu generieren“ klicken

- Wie oft sie den Text direkt in deinem Editor (falls vorhanden) sofort überarbeiten

- Abbrüche mitten in der Session

- Wenn Leute 3–4 Mal pro Eingabe regenerieren, sagt dir das Tool selbst, dass es versagt, auch wenn Umfragen positiv aussehen.

- Miss z. B.:

-

Gezielte Real-User-Tests statt Random Traffic

Hol dir kleine, spezifische Gruppen statt „das ganze Internet“:- Studierende, die AI‑Flags vermeiden wollen

- Freelancer, Texter, Content‑Agenturen

- Nichtmuttersprachler, die Englischtexte polieren

Biete ihnen: - Einen privaten Testraum

- Ein paar feste Aufgaben (Essay‑Einleitung umschreiben, LinkedIn‑Post polieren etc.)

- Jeweils einen 10–15‑minütigen Call oder Screen‑Recording‑Session

Bestech sie mit Amazon‑Gutscheinen, Gratis‑Premium‑Nutzung, was auch immer. Das qualitative Feedback von 20 solchen Leuten ist mehr wert als 2.000 anonyme Klicks.

-

Dein Tool per A/B‑Test gegen einen Benchmark laufen lassen

Frag nicht „Ist das gut?“, sondern „Ist das besser als X?“

Du kannst heimlich laufen lassen:- Version A: roher LLM‑Output

- Version B: dein „humanized“ Output

Zeig das den Testern blind und frag: - „Was klingt eher so, als hätte es ein Mensch geschrieben?“

- „Welche Version würdest du wirklich einreichen/posten?“

Du musst Detektoren hier nicht mal erwähnen.

-

Absichtlich „feindliche“ Reviewer einsetzen

Such Leute, die AI‑Content hassen oder extrem pingelige Lektoren sind.

Sag ihnen:- „Stell dir vor, ein Junior‑Texter hat dir das gegeben. Zerreiß es.“

Ihre Anmerkungen zu Stimme, Wiederholungen, Steifheit und Logikfluss sind viel wertvoller als „ZeroGPT sagt 0 % AI“.

- „Stell dir vor, ein Junior‑Texter hat dir das gegeben. Zerreiß es.“

-

Dogfooding in der Öffentlichkeit – aber ehrlich

Nutze den Output deines Clever AI Humanizer für:- Deine Produktseiten‑Texte

- Release Notes

- Blogposts

Und schreib unten eine kleine Zeile dazu:

„Dieser Beitrag wurde mit Clever AI Humanizer entworfen und leicht von einem Menschen bearbeitet. Fühlte sich irgendetwas komisch an? Sag uns Bescheid.“

Du bekommst knallhartes, ungefiltertes Feedback von Leuten, die sich genug interessieren, um sich zu beschweren. -

„Failure Modes“ testen, nicht nur „Best Case“

Die meisten Tools sehen bei sauberem, formellem Text okay aus. Du solltest testen:- Chaotische Prompts

- Kaputtes Englisch

- Slang, Emojis, komisches Layout

- Superkurze Sachen wie E‑Mail‑Betreffzeilen

Frag Nutzer: - „Wo hat es komplett versagt?“

Logge und kategorisiere diese Fehlschläge.

-

Auf das „Vibes‑Problem“ achten

Selbst wenn Detektoren 0 % AI anzeigen, fühlt sich viel Text immer noch „maschinenförmig“ an: gleicher Rhythmus, saubere Absatzstruktur, vorhersehbare Übergänge.

Das fängst du mit Detektoren nicht ein.

Du kannst es aber einfangen, wenn du:- Nutzer fragst: „Klingt das wie du?“

- Sie „Vorher“ und „Nachher“ einfügen lässt und fragst, welche Version sie wirklich ihrem Chef oder Professor schicken würden.

-

Nicht zu sehr auf das Umgehen von Detektoren fixieren

Leichte Gegenposition zum detektorzentrierten Blick von @mikeappsreviewer: Nutzer denken, sie wollen „0 % AI“, aber langfristig bleiben sie wegen:- Es trifft ihren Ton

- Es erfindet keine Lügen

- Es lässt sie nicht wie einen generischen 08/15‑Blogger klingen

Stell UX an erste Stelle, „Undetectability“ an zweite. Sonst hängst du in einem Katz‑und‑Maus‑Spiel fest, das du am Ende verlierst.

-

Interne, brutal ehrliche „Qualitätsanzeige“ bauen

Intern versiehst du jeden Lauf (anonymisiert) mit:

- Detektor‑Scores

- Menschlichem Rating (von einem kleinen Panel, dem du vertraust)

- Nutzerfeedback („Nerv‑Notizen“)

Jeden Monat schaust du dir die schlechtesten 5–10 % Outputs an. Genau dort liegt das Gold.

Wenn du einen konkreten nächsten Schritt willst:

- Richte eine kleine „Beta‑Tester“-Seite für Clever AI Humanizer ein.

- Begrenze sie auf z. B. 50 echte Nutzer.

- Mach den Deal glasklar: „Nutze es kostenlos, aber du musst uns jede Woche 3 Beispiele schicken, wo es schlecht war oder sich komisch angefühlt hat.“

Dir fehlen nicht wirklich Nutzer. Dir fehlt strukturiertes, schmerzhaftes Feedback. Bau dir die Kanäle dafür, und du lernst in zwei Wochen mehr als durch weitere 20 Screenshots von Detector‑Dashboards.

Kurze Antwort: Detector-Screenshots und KI-Selbstbewertungen sind keine „echten Nutzer-Feedbacks“, sondern ein Laborexperiment. Du bist auf dem richtigen Weg, aber du fragst das falsche Publikum.

Ein paar Gedanken, die nicht einfach wiederholen, was @mikeappsreviewer und @kakeru schon gesagt haben:

-

Frag nicht, ob es „funktioniert“, sondern für wen es funktioniert

Im Moment jagst du eher einer universellen Antwort hinterher: „Ist mein AI Humanizer gut?“ Das ist zu vage. In der Praxis gibt es sehr unterschiedliche Einsatzfälle:

- Studierende, die nicht geflaggt werden wollen

- Texter:innen, die Entwürfe weniger robotisch machen wollen

- Nicht-Muttersprachler, die in E-Mails natürlicher klingen wollen

- Marketer, die ihre Markenstimme halten wollen

Dein Feedback-Problem könnte sein: Du lässt alle rein und hörst auf keine konkrete Gruppe. Such dir ein oder zwei Segmente und optimiere die Feedback-Loops genau dafür.

-

Biete meinungsstarke Presets an und beurteile, welches am meisten missbraucht wird

Statt generischer Modi wie „einfach akademisch“ oder „locker“, binde sie enger an reale Situationen:

- „College-Essay Feinschliff“

- „LinkedIn Thought Leadership“

- „Kalte E-Mail an eine Führungskraft“

- „Blog-Intro verbessern“

Dann:

- Track, welches Preset am meisten genutzt wird

- Track, bei welchem am häufigsten „Alles kopieren“ ohne Änderungen geklickt wird

- Track, welches Nutzer mitten im Flow abbrechen

Wenn „College-Essay Feinschliff“ extrem viel genutzt wird, aber Leute nach einem Durchlauf abspringen, hast du konkrete, umsetzbare Fehlersignale. Das ist wertvoller als noch ein Detector-Screenshot.

-

Baue einen Vergleich „Meine Stimme vs. humanisierte Stimme“ ein

Hier weiche ich etwas vom starken Detector-Fokus der anderen ab: Langfristig ist Menschen ihre eigene Stimme wichtiger als 0 % KI-Erkennung. Wenn der Text nicht mehr nach ihnen klingt, werfen sie dein Tool weg – auch wenn er „nicht detektierbar“ ist.

Lass Nutzer:

- Originaltext einfügen

- Humanisierte Version bekommen

- Eine kurze Diff-Übersicht sehen:

- „Formality: +20 %“

- „Persönlicher Ton: -30 %“

- „Satzlänge: +15 %“

Frag dann ganz direkt:

„Klingt das noch nach dir?“ [Ja / Geht so / Nein]

Diese eine Frage gibt dir ehrlicheres Signal als „Bewerte mit 1–5 Sternen“.

-

Du brauchst negative Anreize, nicht nur Belohnungen

Alle reden über Gutscheine, Beta-Perks usw. Problem: Leute sagen dir, was du hören willst, um die Perks zu behalten.

Versuch das:

- „Wenn du uns 3 wirklich schlechte Ergebnisse schickst (Screenshot oder Paste), schalten wir dir X zusätzliche Credits frei.“

- Du belohnst nicht „Tool oft nutzen“, sondern „Stellen finden, an denen es scheitert“.

So bleibt der Fokus auf Schwachstellen statt auf vagem „ja, ist gut, danke“.

-

Erstelle intern eine „Hall of Shame“

Du weißt schon, dass das Tool unter Idealbedingungen gut performen kann. Was dir fehlt, ist ein kuratierter Haufen:

- Schlechteste Outputs

- Unangenehmste Formulierungen

- Fälle, in denen die Bedeutung verändert wurde

- Fälle, in denen der Nutzer wie ein generischer KI-Blogger klingt

Zieh einmal pro Woche:

- Die 50 Sessions mit den meisten schnellen Regenerierungen

- Die 50 mit dem schnellsten Schließen nach Output

Inspecte manuell 10–20 davon und tagge, warum sie schlecht waren. Diese Muster bringen dich weiter.

-

Erzwinge an einer Stelle im Funnel etwas Reibung

Du optimierst vermutlich auf „kein Login, super schnell, kaum Reibung“. Gut für Traffic, schlecht für Feedback.

Überleg dir einen separaten „Pro Feedback Sandbox“-Bereich:

- Erfordert E-Mail oder ein Minimal-Sign-up

- Bietet höhere Limits oder Extra-Modi

- Im Gegenzug:

- Setzen Nutzer 2 Häkchen pro Output: „Natürlich / Robotisch“ und „On-Topic / Abgedriftet“

- Optional Kontext wie „Ich nutze das für [Schule / Arbeit / Socials]“

Leute, die sich die 20 Sekunden zum Anmelden nehmen, geben weit eher echtes Feedback als zufällige Besucher.

-

Verankere Erwartungen direkt im UI

Leichte Abweichung von einer stillschweigenden Annahme, die du vielleicht hast: „Wenn es gut genug ist, sollten Nutzer einfach kopieren und fertig sein.“ So behandeln echte Menschen solche Tools nicht.

Schreib explizit sowas wie:

„Das bringt dich 70–90 % des Weges. Du musst es einmal kurz selbst gegenlesen, bevor du es einreichst.“

Und frag dann direkt:

- „Musstest du das noch stark bearbeiten?“ [Ein wenig / Viel / Im Grunde komplett neu geschrieben]

Das ist ehrliches Feedback, ohne dass du einen langen Fragebogen brauchst.

- „Musstest du das noch stark bearbeiten?“ [Ein wenig / Viel / Im Grunde komplett neu geschrieben]

-

Nutze den Vergleich mit Wettbewerbern, ohne cringy zu sein

Weil Leute offensichtlich auch Tools wie den Humanizer von Grammarly, Ahrefs, Undetectable etc. testen, kannst du das nutzen, statt so zu tun, als gäbe es sie nicht.

Füge eine kleine Checkbox-Frage ein:

- „Hast du ähnliche Tools ausprobiert (z. B. die AI Humanizer von Grammarly oder Ahrefs)?

- Ja, und dieses ist besser

- Ja, und dieses ist schlechter

- Ungefähr gleich

- Habe keine anderen probiert“

Kein Brand-Bashing, kein „wir sind die Besten“-Hype. Nur Daten.

Nutze das für dein Positioning, nicht nur zur Qualitätsmessung. - „Hast du ähnliche Tools ausprobiert (z. B. die AI Humanizer von Grammarly oder Ahrefs)?

-

Hör auf, Detector-Erfolg mit Produkt-Erfolg gleichzusetzen

Basierend auf dem, was @mikeappsreviewer gezeigt hat, ist dein Clever AI Humanizer schon ziemlich gut gegen öffentliche Detectoren. Schön. Aber frag dich:

- „Wenn morgen alle Detectoren verschwinden würden, wäre mein Tool dann trotzdem nützlich?“

Wenn die ehrliche Antwort „eigentlich nicht“ ist, sollte deine Roadmap mehr in Richtung gehen:

- Personalisierung

- Tonkontrolle

- Sicherheit (keine Halluzinationen, keine falschen Behauptungen)

- Erhalt der ursprünglichen Intention

Das sind die Dinge, die bleiben, wenn das Detector-Wettrüsten nachlässt.

-

Positioniere Clever AI Humanizer explizit als Kollaborations-Tool

Du bekommst viel besseres Feedback, wenn du aufhörst, es als Tarnkappe zu verkaufen.

Beispiel im UI:

„Von KI entworfen, von Clever AI Humanizer verfeinert, von dir fertiggestellt.“

Das bringt Nutzer dazu, zu denken:

- „Wobei hat es mir geholfen?“

- „Wo hat es mir die Arbeit erschwert?“

Frag dann in diesem Rahmen nach Feedback:

- „Hat dir Clever AI Humanizer bei diesem Text Zeit gespart?“ [Ja / Nein]

- „Hat es deine Bedeutung verändert?“ [Ja / Nein]

Der Schnittpunkt „Keine Zeit gespart“ + „Bedeutung verändert“ ist genau da, wo du am stärksten scheiterst.

Wenn du einen sehr praktischen Schritt suchst, den du an einem Tag umsetzen kannst:

- Zeig nach jedem Output 3 Buttons:

- „Das würde ich so abschicken“

- „Ich würde es nutzen, muss aber noch editieren“

- „Das ist nicht brauchbar“

- Wenn sie Letzteres wählen, frag nur noch einmal kurz nach:

- „Zu robotisch / Thema verfehlt / Falscher Ton / Schlechtes Englisch / Sonstiges“

Dieser kleine Flow wird dir in der Masse mehr über die echte Performance von Clever AI Humanizer sagen als ein weiterer Monat Detector-Tests oder das ständige Fragen anderer LLMs, ob sie „getäuscht“ wurden.

Schnelle analytische Einschätzung aus einem anderen Blickwinkel, da andere bereits tief in UX und Tests eingestiegen sind:

1. „Echtes Feedback“ als Daten, nicht als Meinungen behandeln

Statt weitere Detector-Experimente zu fahren, solltest du harte Metriken rund um Clever AI Humanizer einbauen:

Zentrale Zahlen zum Tracken:

- Abschlussrate: Text eingefügt → humanisieren → kopieren.

- Regenerationsrate pro Eingabe: viele Regenerationen = Unzufriedenheit.

- Zeit bis zum Kopieren: wenn Leute innerhalb von 2–5 Sekunden kopieren, lesen sie nicht, sie „farmen“.

- Copy-Absicht: Klick auf „Mit Formatierung kopieren“ vs „Nur Text kopieren“ vs „Download“. Unterschiedliche Muster stehen fast immer für unterschiedliche Use Cases.

So bekommst du stilles Feedback aus jeder Session, nicht nur von den wenigen Leuten, die bereit sind, dir Absätze zu schreiben.

2. Leichtgewichtiges Cohort-Labeling

Andere haben Persona-Targeting vorgeschlagen. Ich würde es radikal einfach halten:

Beim ersten Nutzen ein 1-Klick-Auswahlfeld über der Box:

- „Ich nutze das für: Schule / Arbeit / Social / Sonstiges“

Kein Login, keine Hürde. Nur ein anonymer Cohort-Tag.

Dann kannst du sehen:

- Schule: höchste Regenerations- und Abbruchrate

- Arbeit: längste Verweildauer, aber hohe Copy-Rate

- Social: schnelles Kopieren, geringe Textlänge, vielleicht nicht optimierungswürdig

Du rätst nicht mehr, bei welcher Zielgruppe du scheiterst.

3. A/B-Test „aggressive vs. konservative“ Humanisierung

Aktuell wirkt Clever AI Humanizer auf Detektor-Umgehung plus Lesbarkeit optimiert. Das ist okay, aber unterschiedliche Nutzer wollen unterschiedliche Bearbeitungstiefen.

Fahre einen stillen Split-Test:

- Version A: minimale Änderungen, Struktur bleibt erhalten, leichte Paraphrasierung

- Version B: stärkeres Umschreiben, mehr Variation, deutlich veränderte Rhythmik

Vergleiche dann:

- Welche Version führt eher zu „kopieren und gehen“

- Welche Version löst öfter „Erneut ausführen“ aus

Keine Umfragen, kein Betteln um Feedback. Verhalten ist die Antwort.

4. Pro / Contra als Produkt-Realitätscheck

Im Vergleich zu dem, was @kakeru und @andarilhonoturno beschrieben haben, liegt dein Tool aus meiner Sicht schon in der Kategorie „besser als der Durchschnitt“, aber es hilft, Dinge klar zu benennen:

Stärken von Clever AI Humanizer

- Gute Performance gegen gängige AI-Detektoren bei realistischen Inhalten.

- Output liest sich meist sauber und grammatikalisch korrekt, ohne den erzwungenen „Tippfehler-Spam“, den manche Tools nutzen.

- Mehrere Stile (Simple Academic, Casual, etc.), die ziemlich gut zu realen Schreibsituationen passen.

- Integrierter AI-Writer, der in einem Durchgang generieren und humanisieren kann und so offensichtliche LLM-Fingerabdrücke reduziert.

- Kostenlos und schlank im Onboarding, was für frühe Adoption super ist und viele Testdaten in den Funnel bringt.

Schwächen von Clever AI Humanizer

- Wortzahlkontrolle ist ungenau, ein echtes Problem bei strikten Aufgabenstellungen und Briefings.

- Teilweise zu aggressive Umschreibungen, die zu Content-Drift führen, den Nutzer nicht immer bemerken.

- Selbst bei 0 % AI-Scores wirken manche Texte in Struktur und Rhythmus noch „maschinenförmig“.

- Detector-zentrierter Value Proposition hält dich in einem dauernden Katz-und-Maus-Spiel und könnte schnell veralten.

- Wenig explizite Voice-Personalisierung, sodass Vielnutzer das Gefühl bekommen können, ihr Schreiben klinge immer ähnlicher.

5. Nicht auf Detektoren, sondern auf Wiederkehrer „überfitten“

Hier bin ich nicht ganz bei dem starken Detector-Fokus, der in den Tests von @mikeappsreviewer durchscheint. Detector-Screenshots taugen für Marketing, sind aber ein brüchiges Produktziel.

Robustere Signale:

- Wie viele Nutzer kommen innerhalb von 7 Tagen zurück

- Bei Wiederkehrern: wie stark wachsen die Sitzungen im Wortumfang über die Zeit (Vertrauenssignal)

- Wie oft derselbe Browser / dieselbe IP das Tool in unterschiedlichen Kontexten nutzt (Schule + Arbeit etc.)

Echte Nutzer bleiben nicht, weil ein Detektor „0 % AI“ gesagt hat. Sie bleiben, weil:

- es ihnen Zeit gespart hat.

- es sie nicht blamiert hat.

- es ihre Aussage nicht verfälscht hat.

Optimiere zuerst auf wiederkehrendes Verhalten, danach auf Detector-Scores.

6. Eher ein „Trust Pattern“ als ein „Cloak Pattern“ bauen

Du solltest nicht versuchen, jeden zukünftigen Detektor zu schlagen. Du solltest das Tool sein, das:

- Semantik intakt lässt.

- Ton anpassbar macht.

- Grenzen und Schwächen klar dokumentiert.

Eine subtile UI-Ergänzung mit großem Effekt:

- Nach dem Output eine kurze, ehrliche Zusammenfassung anzeigen, etwa:

- „Bedeutung erhalten: hoch“

- „Tonverschiebung: moderat“

- „Satzstruktur geändert: stark“

Menschen beginnen dir zu vertrauen, weil du deine Arbeit transparent machst. Dieses Vertrauen bringt dir indirekt besseres Feedback als jede Umfrage.

7. Qualitatives Feedback bekommen, ohne zu nerven

Nutze verhaltensbasierte Trigger:

-

Wenn ein Nutzer 3+ Regenerationen auf dieselbe Eingabe fährt:

- Winziger Inline-Prompt:

- „Bekommst du nicht, was du brauchst? Sag es uns in 5 Wörtern.“ [kleines Textfeld]

Das liefert brutal ehrliche Kommentare wie „zu robotisch“, „meine Aussage verändert“, „zu wortreich“.

- „Bekommst du nicht, was du brauchst? Sag es uns in 5 Wörtern.“ [kleines Textfeld]

- Winziger Inline-Prompt:

-

Wenn ein Nutzer >40 Sekunden Text in deinem Textfeld bearbeitet, bevor er humanisiert:

- Frage: „Korrigierst du AI-Text oder polierst du deinen eigenen?“

So verstehst du, ob Clever AI Humanizer eher als „AI-Fixer“ oder als „Editor“ wahrgenommen wird, was wichtig für deine Roadmap ist.

- Frage: „Korrigierst du AI-Text oder polierst du deinen eigenen?“

Keine großen Modals, keine „Bewerte uns mit 5 Sternen“, nur kleine, kontextbezogene Nudges.

8. Wie Wettbewerber in dein mentales Modell passen

Du hast bereits gute Vergleichsarbeit von Leuten wie @kakeru und den stärker detektorzentrierten Review von @mikeappsreviewer. Nutze sie als Benchmarks, aber nicht als Nordstern.

Behandle andere als:

- „So sieht es aus, wenn man Detektor-Umgehung hochdreht und Voice ignoriert.“

- „So sieht es aus, wenn man nur leicht paraphrasiert, sicher bleibt, aber gut erkennbar ist.“

Der Vorteil von Clever AI Humanizer liegt bisher im Versuch, Lesbarkeit und Erkennung auszubalancieren. Dein nächster Vorteil sollte Personalisierung und Kontrolle sein, nicht nur niedrigere Prozentwerte auf noch einem öffentlichen Detektor.

Wenn du eine konkrete Sache suchst, die du diese Woche shippen kannst und die sowohl das Produkt verbessert als auch echte Signale liefert:

- Füge vor dem Humanisieren zwei Toggles hinzu:

- „Struktur so weit wie möglich erhalten“

- „Struktur ändern für mehr menschliche Variation“

Logge dann, welche Toggle-Kombination korreliert mit:

- höheren Copy-Raten

- weniger Regenerationen

- mehr wiederkehrenden Sessions

Du wirst sehr schnell wissen, welche Art von „Humanisierung“ deine realen Nutzer wirklich wollen, statt aus Detector-Charts zu raten.