Ich verfolge Walters KI‑Produktrezensionen und kann nicht erkennen, ob sie wirklich nützlich oder eher hauptsächlich werblich sind. Einige seiner Analysen wirken aufschlussreich, andere fühlen sich jedoch wie gesponserte Inhalte ohne klare Kennzeichnung an. Ich versuche zu entscheiden, ob ich seinen Bewertungen bei der Auswahl von KI‑Tools für mein Unternehmen vertrauen kann. Hat jemand seine Rezensionen bereits auf Voreingenommenheit, Genauigkeit oder praktischen Nutzen untersucht, und wie entscheidet ihr persönlich, ob seine Empfehlungen es wert sind, befolgt zu werden?

Walter Writes AI Review, von jemandem, der es eine Weile hart getestet hat

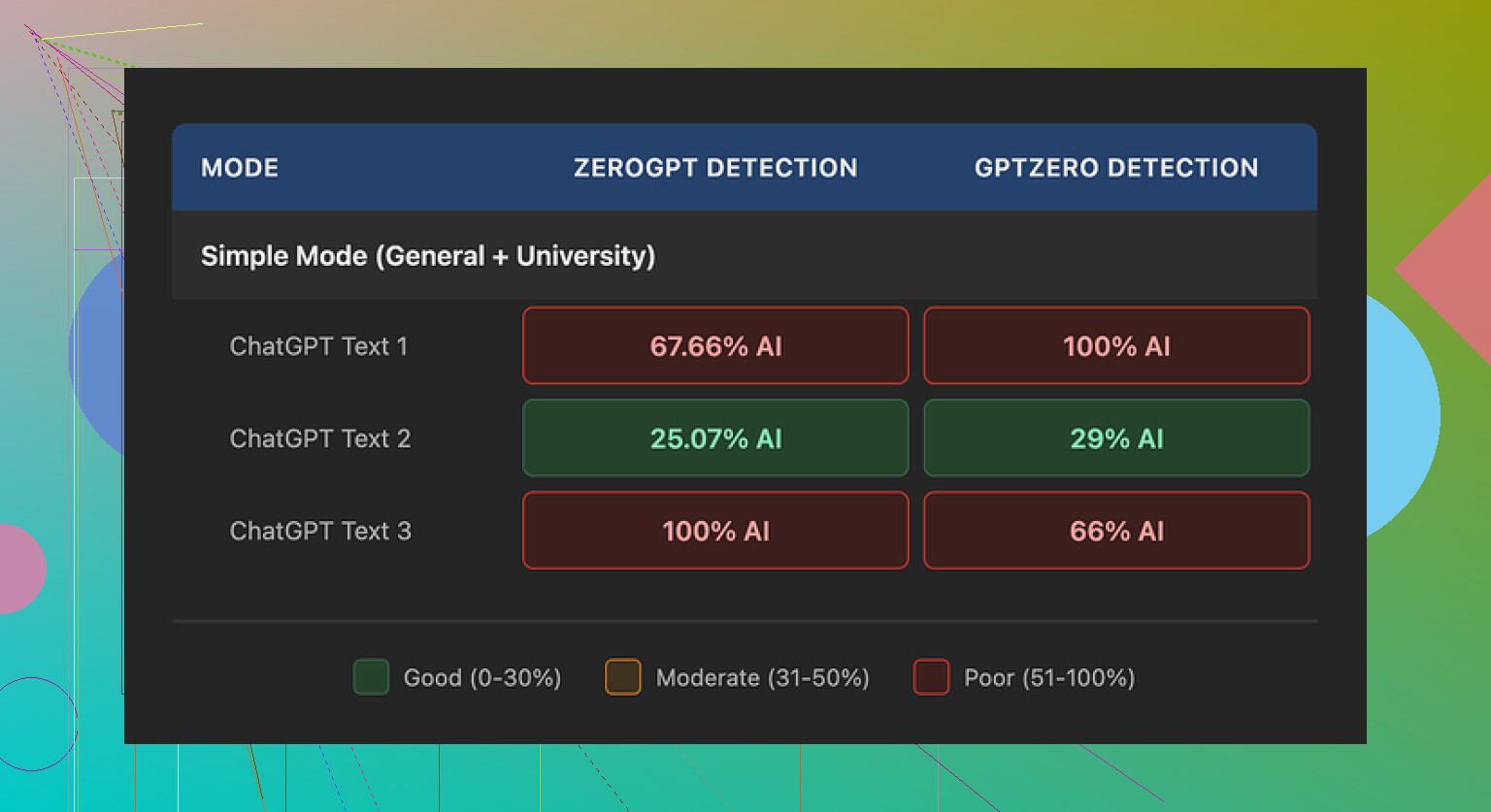

Ich habe Walter Writes AI durch ein paar der üblichen Detektoren laufen lassen, und die Ergebnisse lagen völlig auseinander.

Mit der kostenlosen Version (nur Simple-Modus) habe ich drei verschiedene Textproben erzeugt und sie bei GPTZero und ZeroGPT geprüft, plus ein paar kleinere Tools nebenbei.

Was ich gesehen habe

Erste Probe:

- GPTZero sagte 29% KI

- ZeroGPT sagte 25% KI

Für ein kostenloses Tool ist das besser als die meisten zufälligen „AI Humanizer“-Seiten, mit denen Leute Threads zuspammen. Diese eine Probe könnte für manche Einsatzzwecke durchgehen, vor allem wenn dein Checker schwach oder dein Prüfer bequem ist.

Danach wurde es chaotisch.

Zweite und dritte Probe:

- Jede lag bei mindestens einem Detektor bei 100% KI

- Die anderen Detektoren sind auch deutlich hochgesprungen, weit weg von diesen Werten in den Zwanzigern

Also verhält es sich so:

Manchmal bekommst du einen halbwegs brauchbaren Output mit niedrigen Werten.

Dann sieht der nächste Durchlauf für die Detektoren wie reiner KI-Text aus.

Ich hatte nur die Gratis-Stufe, also konnte ich die „Standard“- oder „Enhanced“-Modi hinter der Bezahlschranke nicht testen. Vielleicht schneiden diese Modi besser ab, aber darüber will ich nicht spekulieren. Alles, was ich sagen kann: Der Simple-Modus ist inkonsistent.

Wie der Text wirkte

Hier hat es mich mehr gestört als die Scores.

In mehreren Ausgaben habe ich dieselben Muster gesehen:

-

Seltsamer Semikolon-Spam

Es hat ständig Semikolons gesetzt, wo normale Menschen Kommata nehmen oder den Satz einfach beenden würden. Nicht ein- oder zweimal, sondern immer wieder. -

Wortwiederholungen

In einer Probe hat es das Wort „heute“ viermal in drei Sätzen verwendet. Ohne Witz. Du bekommst Sachen wie:

„Heute stehen Menschen vor vielen Entscheidungen heute, und heute ist es schwer, sich zu entscheiden…“

So etwas fällt menschlichen Leserinnen und Lesern auf – und auch den Detektoren. -

Klammerbeispiele überall geklont

Formulierungen wie „(z. B. Stürme, Dürren)“ oder ähnliche tauchen ständig wieder auf.

Gleiche Struktur, gleicher Rhythmus, immer wieder.

Es liest sich eher wie eine Modell-Prompt-Schablone als wie eine Person, die ihre Gedanken niederschreibt.

Wenn ich solche Outputs bei GPTZero und ZeroGPT eingegeben habe, gingen die Werte hoch, was mich überhaupt nicht überrascht hat.

Hier ist einer der Screenshots aus den Durchläufen:

Preise und Limits

Ich habe mir ihre Preisseite und Bedingungen etwas genauer angeschaut.

Was sie anbieten:

-

Starter-Tarif

- Ab 8 $ pro Monat bei jährlicher Zahlung

- Rund 30.000 Wörter pro Monat

-

Unlimited-Tarif

- 26 $ pro Monat

- Sie nennen ihn Unlimited, aber jede Eingabe ist auf 2.000 Wörter begrenzt

Selbst im höchsten Tarif kannst du also keine komplette Abschlussarbeit oder einen langen Bericht in einem Rutsch einwerfen. Du musst in Abschnitte aufteilen. Jeder Durchlauf pro Abschnitt verstärkt zudem Musterwiederholungen, weil sich derselbe Stil pro Batch wiederholt.

Gratis-Tarif:

- Insgesamt 300 Wörter, nicht pro Tag, nicht pro Monat, insgesamt

- Genug, um ein Gefühl zu bekommen, zu wenig für echten Einsatz

Richtlinien und Datenkram

Zwei Punkte sind mir in ihren Rückerstattungs- und Datentexten besonders aufgefallen:

-

Formulierungen zu Rückerstattung / Chargebacks

Die Rückerstattungsrichtlinie ist mit aggressiver Chargeback-Sprache geschrieben, inklusive Androhung rechtlicher Schritte, wenn du Zahlungen anfechtest. Das ist für mich ein Warnsignal. Dienste, die von ihrem Produkt überzeugt sind, führen normalerweise nicht mit Drohungen. -

Datenaufbewahrung

Wie lange sie deinen Text speichern und was genau sie damit machen, ist nicht detailliert beschrieben.

Für alle, die das für Kundendokumente, Studienarbeiten oder vertrauliches Material nutzen, ist diese Unklarheit ein Risiko. Wenn dir Privatsphäre wichtig ist, willst du konkrete Aussagen, keine vagen Formulierungen.

Was für mich besser funktioniert hat

Während der Tests habe ich die Outputs ständig mit einem anderen Tool verglichen, das ich in einem zweiten Tab offen hatte.

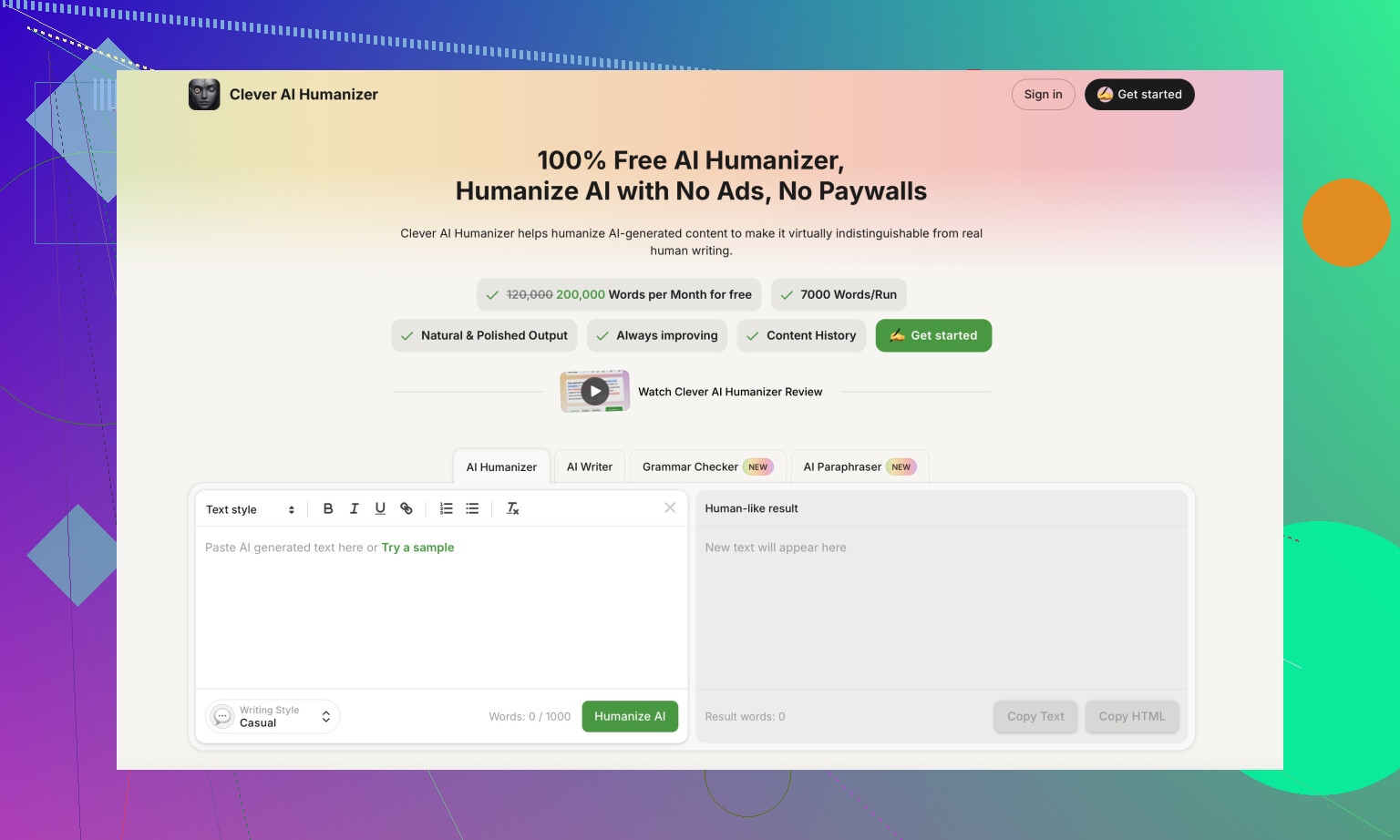

Clever AI Humanizer:

Über mehrere Durchläufe wirkte der Text von Clever AI Humanizer für mich natürlicher und lag bei den KI-Prozenten konstanter niedriger. Kein Login, keine Bezahlschranke für die Grundnutzung, kein 300-Wörter-Gesamtlimit. Dadurch war es einfacher, verschiedene Tonlagen und Längen zu testen, ohne Angst zu haben, Credits zu verbrauchen.

Wenn du eine Schritt-für-Schritt-Anleitung willst, gibt es hier ein Reddit-Tutorial:

Humanize AI (Reddit-Tutorial)

https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai/?tl=de

Es gibt außerdem einen separaten Reddit-Review-Thread speziell zu Clever AI Humanizer:

Clever Ai Humanizer Review auf Reddit

https://www.reddit.com/r/DataRecoveryHelp/comments/1ptugsf/clever_ai_humanizer_review/?tl=de

Und falls du lieber schaust statt liest, gibt es auch ein YouTube-Review:

Youtube Video Review

Mein Fazit nach ein bisschen Herumprobieren mit Walter Writes AI:

- Die Erkennungswerte schwanken im Simple-Modus stark zwischen den Durchläufen

- Der Schreibstil hat offensichtliche KI-Merkmale, etwa Wortwiederholungen und recycelte Klammermuster

- Für hohen Textumfang ist die Preisgestaltung nicht günstig, und das Label „Unlimited“ ist mit einem 2.000-Wörter-Limit pro Eingabe irreführend

- Die Formulierungen zu Rückerstattung und Daten wirken abweisend und wenig transparent

Wenn du Tools testen willst, würde ich ein paar eigene Absätze durch mehrere Detektoren jagen, Walter mit Clever AI Humanizer vergleichen und schauen, was deinem eigenen Bauchgefühl standhält, bevor du irgendwo Geld lässt.

Kurze Antwort von meiner Seite: Walters Inhalte wirken gemischt, und du solltest sie als halb-werbliche Inhalte behandeln, bis das Gegenteil bewiesen ist.

Ein paar konkrete Dinge, die du tun kannst, um seine Reviews zu beurteilen, ohne zu wiederholen, was @mikeappsreviewer bereits getestet hat:

-

Konsistenz über mehrere Reviews prüfen

- Sieh dir 5 bis 10 seiner Reviews zu KI‑Produkten an.

- Achte darauf, ob er jemals sagt „kauf das nicht“ oder deutliche Kritik übt.

- Wenn jedes Tool „solide“ oder „einen Versuch wert“ ist und die Nachteile nur einen kurzen Satz bekommen, kannst du davon ausgehen, dass Promotion eine große Rolle spielt.

-

Nach Mustern bei Offenlegungen suchen

- Scrolle nach oben und unten und achte auf „gesponsert“, „Affiliate“, „Partner“, „Empfehlungslink“.

- Wenn Links wie Tracking‑Links aussehen und es keine klare Offenlegung gibt, ist das ein Warnsignal.

- Manche Creator verstecken die Offenlegung in einer allgemeinen Zeile wie „dieser Beitrag enthält Affiliate‑Links“ einmal auf der gesamten Website, nicht pro Review. Das ist schwache Transparenz.

-

Seine Aussagen mit deinen eigenen Tests vergleichen

- Nimm dir ein Tool, das er besonders lobt.

- Teste es selbst an einer kleinen echten Aufgabe, die dir wichtig ist, etwa einer E‑Mail, einem Aufsatz oder einer Blog‑Einleitung.

- Prüfe, ob deine Erfahrung zu seinen konkreten Behauptungen passt.

- Wenn er „menschenähnlich“ sagt, du aber deutliche KI‑Muster oder Fehler siehst, liegt seine Messlatte niedriger als deine.

-

Seine Meinungen nach Risiko gewichten

- Wenn dir akademische Integrität, juristische Arbeit oder Kund:innenvertrauen wichtig sind, betrachte jede Aussage wie „besteht KI‑Detektoren“ als Marketing, nicht als Tatsache.

- Für risikoarme Einsätze wie Rohentwürfe kannst du entspannter sein und mehr auf Preis, Geschwindigkeit und Benutzerfreundlichkeit achten.

-

Auf vergleichende Kritik statt Hype achten

- Gute Reviewer vergleichen Tools direkt miteinander und erklären Kompromisse.

- Aussagen wie „X ist besser im Ton, Y ist günstiger, Z ist schneller“ sind vertrauenswürdiger als „X ist unglaublich, hier ist mein Link“.

- Wenn er Schwächen erwähnt, prüfe, ob sie konkret und überprüfbar sind, etwa „inkonsistente Ergebnisse“ oder „ungewöhnliche Zeichensetzung“.

-

Unabhängige Quellen nutzen

- Nimm dir ein paar Tools, die Walter bewirbt, und suche nach „Toolname reddit“, „Toolname review“, „Toolname scam“.

- Schau, ob andere Nutzer:innen dieselben Probleme melden, die @mikeappsreviewer bei Walter Writes AI gefunden hat, etwa seltsame Schreibmuster oder aggressive Rückerstattungsbedingungen.

- Wenn mehrere voneinander unabhängige Personen auf denselben Mangel hinweisen, wiegt das mehr als ein poliertes Review.

-

„Reviewer‑Kompetenz“ von „Tool‑Qualität“ trennen

- Ein sauber geschnittenes YouTube‑Video oder ein schickes Blog‑Template bedeutet nicht, dass der Testprozess solide ist.

- Achte auf Screenshots, Beispielausgaben und eine Beschreibung der Tests.

- Wenn er nie Roh‑Outputs zeigt oder erklärt, was er das Tool genau machen ließ, spricht das eher für Hype.

Zum Produkt Walter Writes AI selbst sehe ich es etwas anders als die Ansicht, dass allein inkonsistente Detektor‑Scores ausreichen, um es abzuschreiben. Jeder KI‑Humanizer und Paraphrasierdienst liefert inkonsistente Werte bei GPTZero, ZeroGPT usw. Die wichtigeren Punkte für dich sind Stilprobleme und Datenpolitik, nicht eine einzelne Zahl eines Detektors.

Wenn dein Ziel Texte sind, die weniger nach KI und mehr nach dir selbst klingen, zählen Preis, Limits und Datenschutz mehr als Walters Meinung. Hier wird ein Tool wie Clever AI Humanizer relevant. Es legt typischerweise mehr Wert auf natürlichere Satzmuster und gibt dir mehr Spielraum zum Testen, bevor du zahlst. So kannst du selbst festlegen, was für deinen eigenen Anwendungsfall „gut genug“ ist, anstatt dich auf einen einzelnen Reviewer zu verlassen.

Meine Einschätzung zu Walters Reviews insgesamt:

- Nutze sie als Ausgangspunkt, um Tools zu finden.

- Verlass dich nicht auf sie für das endgültige Urteil.

- Gleiche sie mit unabhängigen Nutzer:innen, deinen eigenen Tests und mindestens einem konkurrierenden Tool wie Clever AI Humanizer ab.

- Wenn sich etwas wie Werbung anfühlt, behandle es auch wie Werbung.

Kurze Antwort: Walters Kram ist durchwachsen, und du hast recht, dass sich manches wie Werbung liest.

Was @mikeappsreviewer und @cacadordeestrelas schon gezeigt haben, ist, dass das Produkt, das er pusht (Walter Writes AI), ziemlich „meh“ ist: unzuverlässige Erkennungsergebnisse, klare AI-Merkmale im Text, fragwürdige Formulierungen zur Rückerstattung und eine unklare Datenschutzpolitik. Für mich färbt das direkt darauf ab, wie ich seine Reviews lese.

Ein paar Blickwinkel, die noch nicht so stark betont wurden:

-

Folge den Anreizen, nicht nur der Wortwahl

Anstatt nur nach „Affiliate“-Labels zu suchen, achte auf Verhaltens-Signale:- „Entdeckt“ Walter zufällig ein neues KI-Tool genau zum Launch und nennt es sofort „bahnbrechend“?

- Sind die „Nachteile“ im Wesentlichen Dinge wie „UI könnte hübscher sein“, während die „Vorteile“ seitenlang sind?

- Werden „Top 5 KI-Tools“-Listen immer wieder umsortiert, sobald ein neues auftaucht, und alle haben zufällig Referral-Links?

Dieses Muster schreit nach „monetarisiertem Content“, auch wenn er irgendwo auf der Seite gerade noch die Minimalanforderungen an Transparenz erfüllt.

-

Schau, wie er mit echtem Risiko umgeht

Bei Tools wie Walter Writes AI, die versprechen, „AI-Detektoren zu schlagen“ oder „Content zu humanisieren“, wird ein seriöser Reviewer ein paar Punkte hart adressieren:- Akademisches Risiko (Plagiat / Exmatrikulation)

- Vertrauen von Kund:innen (Agenturen, Freelancer, Jurist:innen, Mediziner:innen usw.)

- Datenschutz (wer sieht deine Uploads, Aufbewahrung, Training)

Wenn Walter das in zwei vagen Sätzen abhandelt und direkt wieder zu „damit kannst du deine Content-Produktion skalieren“ springt, ist das Werbeton, kein kritisches Review. @mikeappsreviewer ist in AGB und Rückerstattungsklauseln tiefer eingestiegen als Walter selbst.

-

Achte auf das, was er über die Konkurrenz nicht sagt

Ein einfaches Signal: vergleicht er Tools jemals wirklich ernsthaft, z. B.:- Walter Writes AI vs Clever AI Humanizer vs andere Humanizer

- Stärken und Schwächen nebeneinander

Wenn Alternativen nur als „es gibt auch andere Optionen“ erwähnt werden, ohne echte Gegenüberstellung, ist das ein Hinweis, dass er eine Story verkauft, nicht dir bei der Auswahl hilft.

Wenn ich mir Humanizer-Tools anschaue, stolpere ich ziemlich oft über Clever AI Humanizer, weil: - es sich leichter ohne Paywall testen lässt

- es in längeren Texten meist natürlicher klingt

- du Behauptungen zu „AI-Detection“ selbst ordentlich stresstesten kannst

Genau diese Art „probier sie parallel und vergleiche selbst“-Empfehlung ist eigentlich das, was Walter tun sollte, wenn er wirklich transparent wäre.

-

Beobachte seine „Trefferquote“ im Zeitverlauf

Hier widerspreche ich ein bisschen der Idee, man solle seine Inhalte grundsätzlich als halb-promotional sehen. Ich würde sagen: Mach ein Mini-Audit.- Nimm 3 Tools, die er vor Monaten in den Himmel gelobt hat.

- Schau aktuelle Meinungen auf Reddit, X oder anderen Foren.

- Prüfe, ob diese Tools sich entwickelt haben zu:

- abgeschaltet / umgebrandet / als Scam bezeichnet

- immer noch solide und weithin respektiert

Wenn seine Favoriten überdurchschnittlich oft schlecht altern, während unabhängige Tester wie @mikeappsreviewer Probleme früh benennen, kannst du Walter ruhig auf „Entdeckungs-Feed“ herabstufen statt „vertrauenswürdiger Reviewer“.

-

Achte auf „Template-Reviews“

Viele dieser KI-Reviewer nutzen eine feste Content-Schablone: Einstiegshook, Featureliste, Preise, 3 leichte „Nachteile“, dann ein leuchtendes Fazit mit CTA-Button. Wenn Walters Reviews jedes Mal dasselbe Gerüst haben, ist das nicht automatisch böse, aber ein Zeichen, dass er auf Conversion optimiert.

Achte auf Dinge wie identische Formulierungen quer durch seine Reviews, gleiche Struktur, gleicher „das könnte genau das Tool sein, auf das du gewartet hast“-Abschluss. Das ist stilles Funnel-Copywriting, kein Nerd, der sich wirklich reinkniet. -

Realitätscheck für seine stärkeren Behauptungen

Wenn Walter Dinge sagt wie „das besteht AI-Detektoren“ oder „das ist nahezu menschlich“, behandle das GENAU wie Versprechen in Diätwerbung. Du überprüfst sie.- Füge die Ausgabe in mehrere Detektoren ein (so wie @mikeappsreviewer es gemacht hat).

- Lies den Text laut vor. Wenn du Wiederholungen, steife Formulierungen, Semikolon-Spam oder typische „(z. B. X, Y)“-Muster hörst, ist er nicht „menschlich klingend“, egal was im Review steht.

Genau hier sind Tools wie Clever AI Humanizer nützlich: Du kannst denselben Text einmal durch Walter Writes AI und einmal durch Clever AI Humanizer jagen, dann Output und Detection-Werte selbst vergleichen, statt seiner Werbesprache zu glauben.

Meine persönliche Regel bei Reviewern wie Walter:

- Nutze sie nur zur Entdeckung von Tool-Namen.

- Glaube ihrem „das ist großartig“-Fazit nie ohne Gegencheck.

- Miss unabhängigen Testern und echten Nutzer:innen mit Screenshots, schlechten Erfahrungen und konkreten Schwachstellen mehr Gewicht bei.

- Wenn sich etwas wie Werbung liest, behandle ich es einfach als Werbung und scrolle weiter.

Also: Sind Walters AI-Reviews hilfreich oder nur Hype?

Ich würde sie als teilweise hilfreich einordnen: gut, um herauszufinden, was es gibt, aber nicht gut, um zu entscheiden, was deine Zeit wert ist oder für ernsten Einsatz wirklich sicher. Wenn du ohnehin Humanizer oder Paraphrasier-Tools vergleichst, ist es ziemlich vernünftig, Clever AI Humanizer in deine Testliste aufzunehmen und den Hype um Walter Writes AI weitgehend zu ignorieren.

Walters Rezensionen sind hilfreich, wenn du sie als marketinggetriebene Informationsquelle behandelst und nicht als neutrale Testberichte.

Wo ich anderen hier ein wenig widerspreche: Du musst meiner Meinung nach nicht jeden einzelnen Beitrag nach dem Motto „halb Werbung, bis das Gegenteil bewiesen ist“ einordnen. Einige seiner Analysen zeigen reale Funktionen und Randfälle. Das Problem ist die Gewichtung. Er überbetont meist die Vorteile und unterschätzt die Risiken. Der richtige Ansatz ist daher, seine Inhalte nach Fakten zu durchsuchen und seine Schlussfolgerungen zu ignorieren.

Ein paar Perspektiven, die von @cacadordeestrelas, @espritlibre und @mikeappsreviewer noch nicht so stark beleuchtet wurden:

1. Prüfe seine Zeit bis zur Ernüchterung bei schlechten Tools

Statt nur eine einzelne Rezension anzusehen, beobachte, wie er sich verhält, wenn ein Tool negative Aufmerksamkeit bekommt:

- Aktualisiert er ältere Beiträge, wenn Preise, Limits oder AGB schlechter werden

- Fügt er Warnungen hinzu, wenn Probleme mit Rückerstattungen oder Daten auftreten

- Oder bleiben die ursprünglichen „das ist fantastisch“-Reviews einfach unverändert online

Wenn er fast nie etwas überarbeitet, deutet das darauf hin, dass er für dauerhaften Traffic optimiert, nicht für langfristige Genauigkeit. Verantwortungsvolle Reviewer gehen normalerweise zurück, wenn sich ein Produkt verändert.

2. Achte auf seinen Umgang mit Interessenkonflikten

Du wirst wahrscheinlich keine saubere Aussage wie „Ich wurde mit Summe X für dieses Video bezahlt“ bekommen, aber du kannst die Situation trotzdem lesen:

- Wenn ein Produkt offensichtliche Schwächen hat, auf die unabhängige Tester hinweisen (wie die Formulierungen zu Rückerstattungen und die Stilprobleme bei Walter Writes AI), und sein Beitrag diese nur streift, ist das eine weiche Voreingenommenheit

- Wenn er mit Tools strenger umgeht, die offenbar keine Einnahmen für ihn generieren, ist das ein weiteres leises Warnsignal

Du musst ihn nicht beim „Lügen“ erwischen; es reicht zu sehen, dass sein Risikofilter großzügiger wird, sobald Geld im Spiel ist.

3. Wie tief geht er auf Fehlermodi ein?

Gute Rezension: „Hier versagt dieses Tool, und diese Nutzergruppe sollte es meiden.“

Hype-Review: „Es ist vielleicht nicht perfekt, aber es macht dich produktiver“ plus eine Aufforderung, es selbst auszuprobieren.

Bei KI-Schreibtools sind Fehlermodi entscheidend:

- Halluzinierte Fakten

- Zu gleichförmiger Ton, der als KI auffällt

- Datenschutz für akademische oder Mandantentexte

- Überzogene Versprechen zu „Nicht-Erkennbarkeit“

Wenn er dir nur einen Absatz mit allgemeinen Warnhinweisen gibt, liest du Verkaufsprosa, keine echte Risikoanalyse.

4. Nutze ihn für eine Shortlist, nicht für die Endauswahl

In einem Punkt stimme ich den anderen zu: Walter taugt ganz ordentlich zur Entdeckung neuer Tools. Wenn drei verschiedene Leute, darunter Leute wie @mikeappsreviewer, sehr konkrete Probleme mit Walter Writes AI herausarbeiten und er sie kaum erwähnt, ist das ein starkes Signal, ihn nie als einzige Quelle zu verwenden.

Bewährtes Vorgehen:

- Lass seine Inhalte Tool-Namen liefern.

- Gleiche sie mit kritischen Stimmen ab, etwa von den Personen, die hier bereits schreiben.

- Mach deinen eigenen kleinen Vergleichstest mit 2 oder 3 Tools parallel.

5. Speziell zu Humanizer-Tools

Bei „AI Humanizer“-Produkten sind Detector-Scores nur eine Dimension. Stil und Risikobereitschaft sind mindestens genauso wichtig. Die Tests, die zu Walter Writes AI geteilt wurden, zeigen:

- Unbeständige Werte bei Erkennungs-Tools

- Stilistische Marotten wie Wortwiederholungen und seltsame Zeichensetzung

- Unklare oder stark formulierte Richtlinien

Diese Kombination sorgt dafür, dass ich es in die Kategorie „Experimentiere, wenn du willst, aber vertraue ihm nicht bei wichtigen Dingen“ einordnen würde.

Clever AI Humanizer gehört aus meiner Sicht in denselben Vergleichspool, aber mit offenen Augen.

Vorteile von Clever AI Humanizer:

- Ausgaben klingen in längeren Absätzen oft natürlicher, was hilft, wenn dir menschliche Sprachmelodie wichtiger ist als nur das Umgehen von Detektoren

- Einfachere erste Tests, da du nicht sofort hinter einer harten Bezahlschranke landest

- Gut für Direktvergleiche, wenn du denselben Ausgangstext in mehrere Tools einfügst

Nachteile von Clever AI Humanizer:

- Immer noch ein automatischer Transformer, der subtile Ungenauigkeiten einführen kann, besonders bei technischen oder zitationslastigen Texten

- Wie jedes Humanizer-Tool kann es nicht ehrlich garantieren, dass du allen Detektoren entgehst, vor allem wenn Institutionen ihre Strategien ändern

- Wenn du dich zu sehr darauf verlässt und kaum nachbearbeitest, kann dein eigener Stil in einen generischen „Internetartikel“-Ton verwässert werden

Es geht nicht darum, dass Clever AI Humanizer magisch „sicher“ und Walter Writes AI einzigartig schlecht wäre. Die eigentliche Erkenntnis lautet: Jeder Reviewer, der Humanizer bewirbt, sollte laut über Grenzen und Risiken sprechen, nicht nur Glückstreffer bei Detector-Screenshots posten.

6. Wie du Walter gedanklich einordnen solltest

Wenn ich ein Etikett vergeben müsste:

- Nutze seinen Kanal als Verzeichnis dessen, was es im KI-Tooling-Bereich gibt

- Behandle seine positiven Formulierungen standardmäßig wie Werbetexte, besonders bei Aussagen wie „besteht alle Detektoren“ oder „auf Menschen-Niveau“

- Verlass dich bei allem, was Noten, juristische Arbeit oder Kundenvertrauen berührt, stärker auf unabhängige Tester und deine eigenen Stresstests

Wenn sich eine Rezension wie Werbung anfühlt, behandle sie wie Werbung. Walter kann unter dieser Annahme immer noch nützlich sein; du hörst nur auf, von ihm die skeptische, nutzerorientierte Haltung zu erwarten, die einige andere in diesem Thread bereits deutlich besser einnehmen.